Einleitung

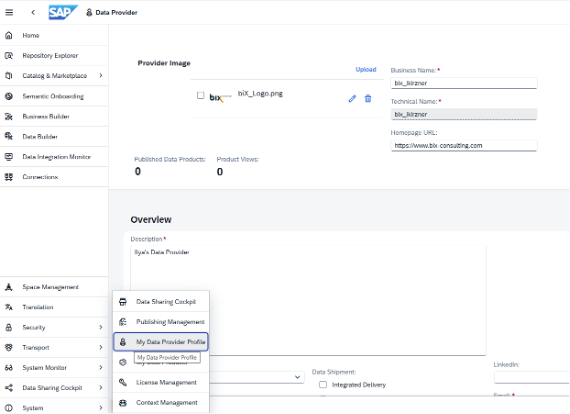

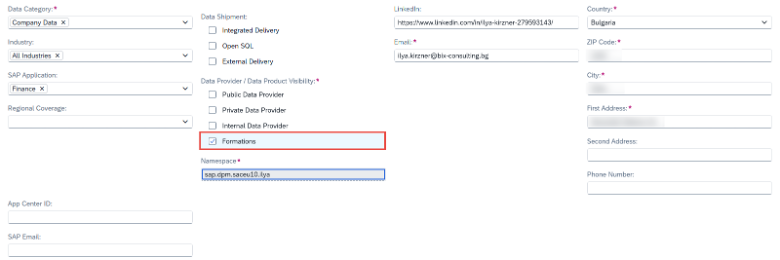

Technische Voraussetzungen: Integration in den Einstein Trust Layer

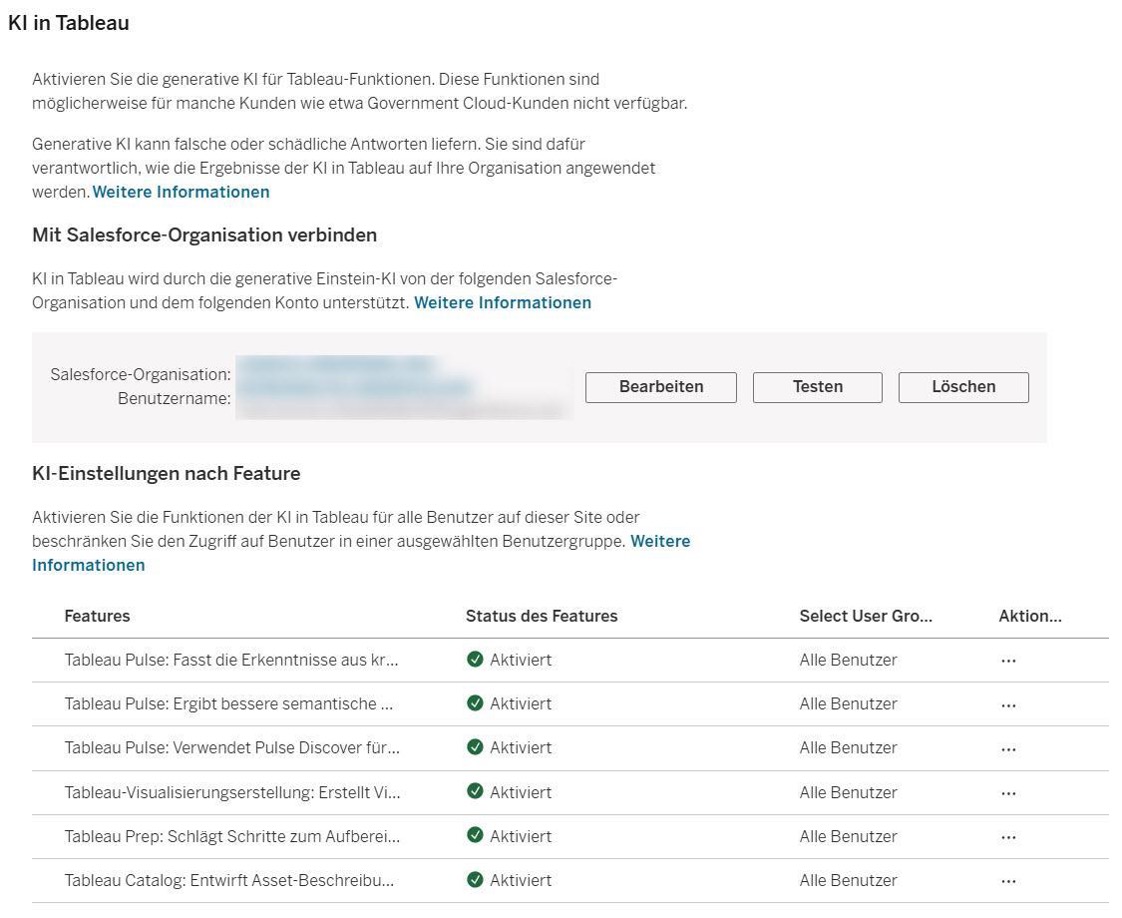

Bevor die KI operativ genutzt werden kann, ist ein Blick auf die Administration der Tableau Umgebung (Tableau Cloud oder Tableau Server) notwendig, um die für die Nutzung der KI notwendigen Einstellungen vorzunehmen.

Die verschiedenen KI-Features von Tableau müssen in diesem Menü aktiviert werden. Damit der Tableau Agent in Prep zur Verfügung steht, muss die Tableau Site explizit mit einer Salesforce-Organisation (z. B. Data Cloud) verbunden werden. Dies stellt sicher, dass alle generativen Anfragen über den Einstein Trust Layer verarbeitet werden, was Datensicherheit und Compliance gewährleistet. Erst nach diesem „Handshake“ stehen die KI-Features in den Site-Einstellungen zur Aktivierung bereit.

Das erste Szenario: Struktur aus unstrukturierten Daten gewinnen

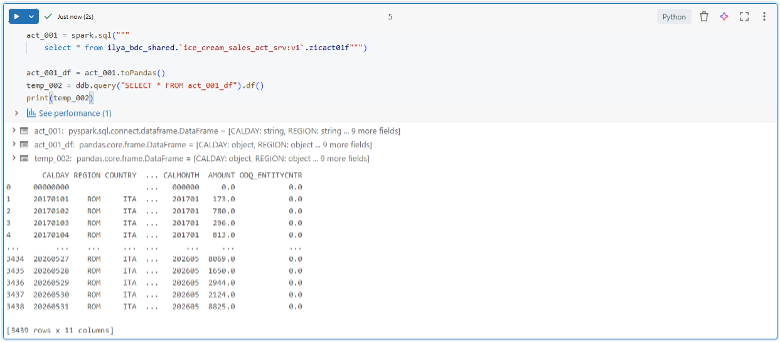

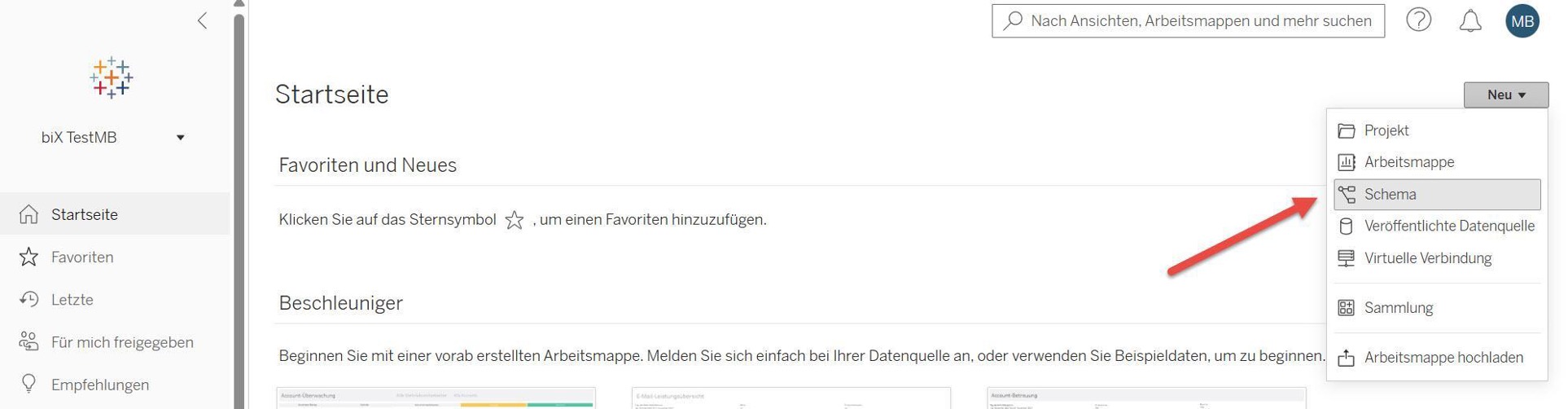

Unser erster Test konzentriert sich auf ein klassisches „Dirty Data“-Szenario. Unser Fokus liegt auf Marketingdaten, die uns in unstrukturierter Form vorliegen. Ziel ist es, diese Daten zu strukturieren, damit wir sie für spätere Analysen nutzen können. Wir erstellen hierfür ein neues Schema in der Tableau Cloud Web-Umgebung und binden Daten aus einer einfachen .csv-Datei an.

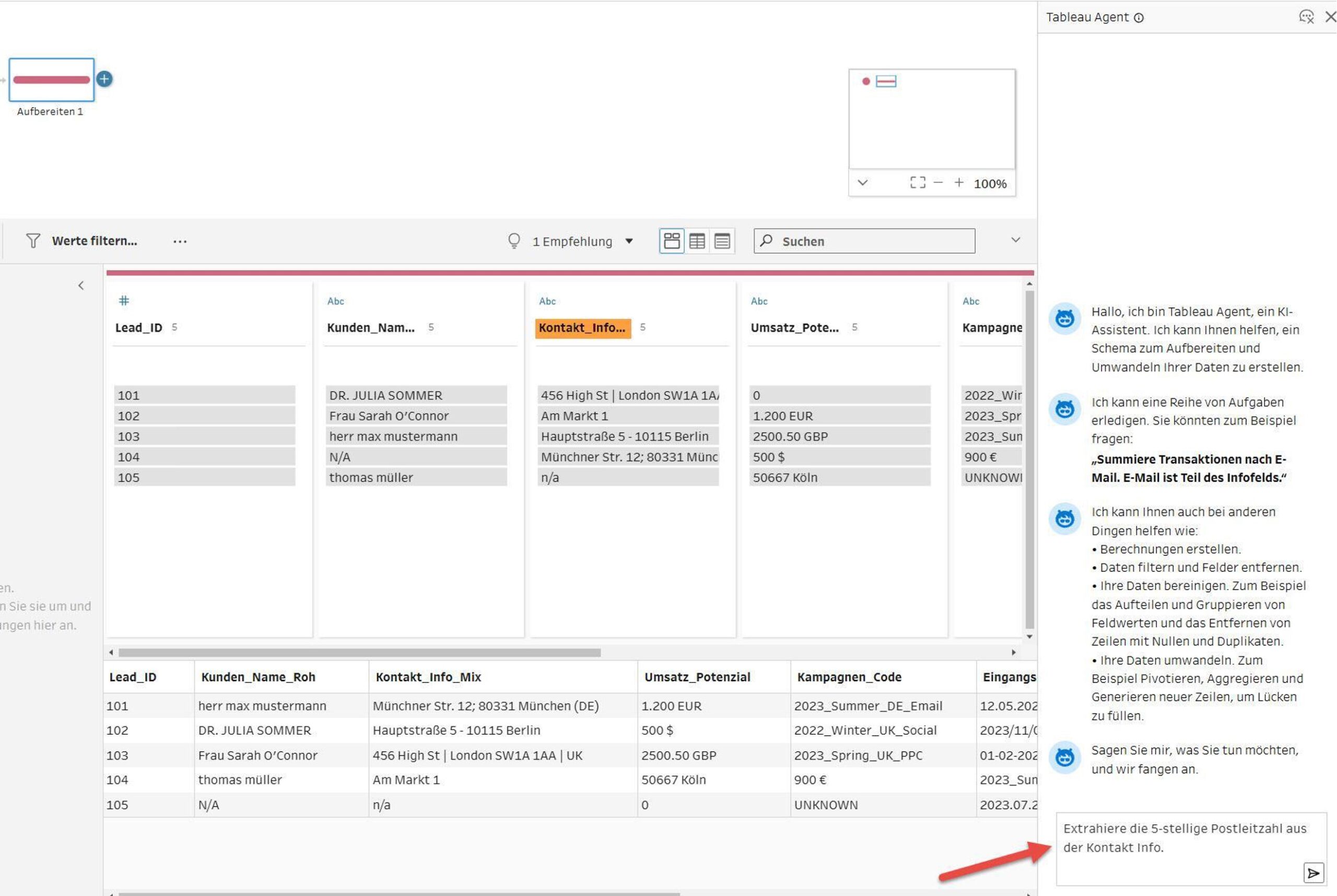

Unser Datenset besteht aus mehreren Spalten, die unstrukturierte Daten enthalten. Im Folgenden werden wir diese Daten mit Hilfe des Tableau Agent bereinigen und strukturieren.

Wir betrachten zunächst das Feld

Kontakt_Info_Mix,

in dem Adresskomponenten (Straße, PLZ, Stadt, Land) ohne festes Trennzeichen aggregiert vorliegen, z.B.:

- Datensatz A:

Münchner Str. 12; 80331 München (DE)

- Datensatz B:

456 High St | London SW1A 1AA | UK

Unser Ziel ist die Extraktion der Postleitzahl und des Ländercodes in dedizierte Spalten, damit diese in einem Dashboard dediziert genutzt werden können. Wir nutzen den Tableau Agent, um die hierfür notwendige “RegEx”-Logik aufzubauen.

Iterative Entwicklung: Die KI als Coding-Partner

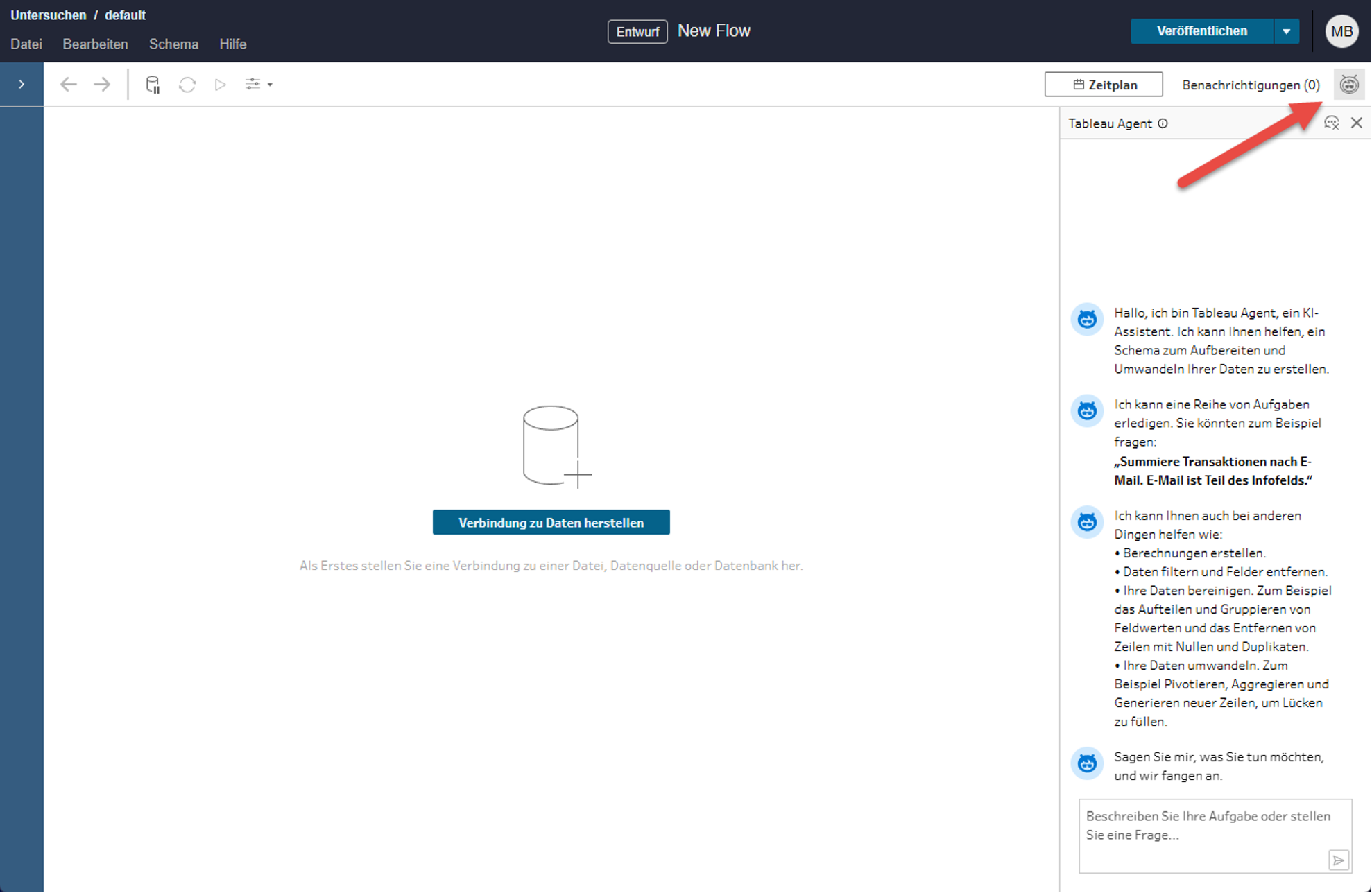

Wir öffnen zunächst den Tableau Agent über das folgende Symbol in der rechten oberen Ecke der Bearbeitungsoberfläche:

Da wir den Tableau Agent im Kontext der Datenaufbereitung nutzen wollen, erstellen wir, nachdem wir unsere Daten angebunden haben, einen neuen Aufbereitungsschritt und markieren selbigen. Anschließend können wir unseren ersten Prompt an den Tableau Agent senden. Wir wollen zunächst versuchen, die 5-stellige Postleitzahl aus den unstrukturierten Daten zu extrahieren – zum Beispiel, um geografische Analysen auf Basis der Postleitzahl zu ermöglichen.

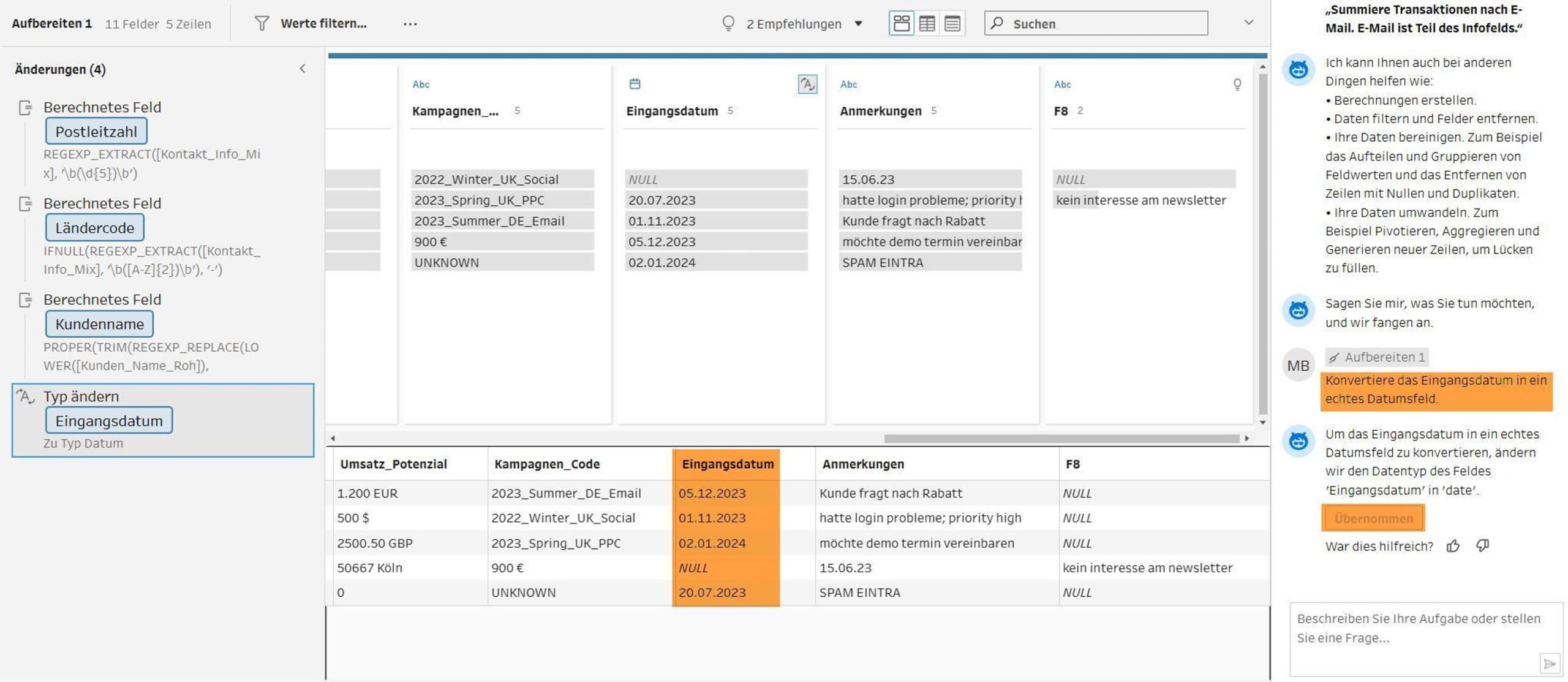

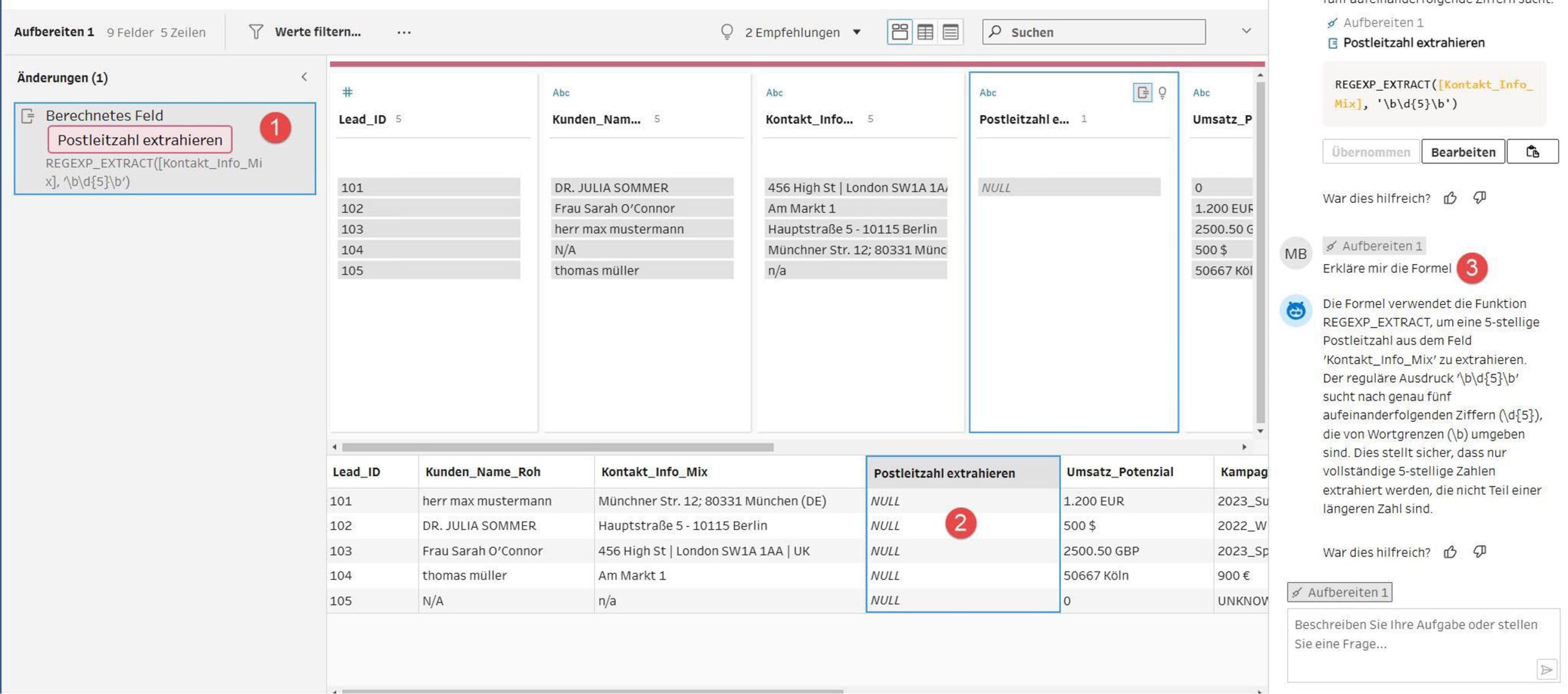

Nachdem die vom Tableau Agent vorgeschlagene Formel übernommen und ein neues Feld erstellt wurde (1), offenbart sich eine wichtige Lektion für Data Engineers. Der Agent identifiziert zwar das korrekte Muster, doch die Vorschau zeigt NULL-Werte (2). Um dieses Problem verstehen und beheben zu können, können wir zunächst die vom Tableau Agent bereitgestellte Erläuterung der erstellten Formel (3) betrachten.

Erfahrene Tableau-Entwickler können hier feststellen, dass die vom Tableau Agent genutzte Funktion REGEXP_EXTRACT in Tableau zwingend eine sogenannte „Capturing Group“ (gesetzt durch Klammern) erfordert, um einen Wert nicht nur zu finden, sondern auch zurückzugeben. Die KI lieferte die korrekte Syntax für das Matching, aber nicht für die Extraktion.

Im ersten Versuch liefert der Tableau Agent somit zwar einen guten ersten Ansatz, jedoch noch keine fertige Lösung. Dies kann insbesondere für Tableau-Benutzer ohne tieferes technisches Wissen eine Herausforderung darstellen.

Verfeinerung und Ergebnis: Präzision durch Context Prompting

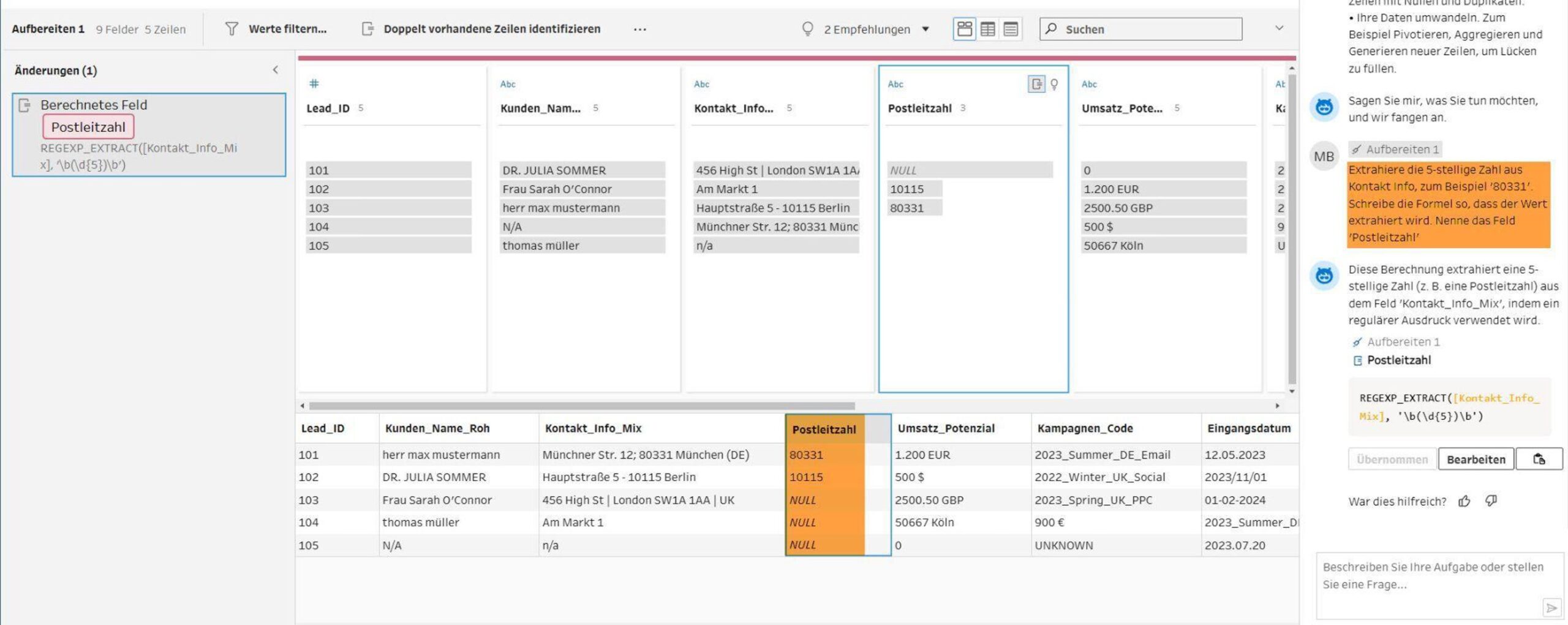

Um das Ergebnis zu korrigieren, präzisieren wir unseren Prompt. Wir instruieren den Agenten nicht nur „Was“ extrahiert werden soll (5 Ziffern), sondern auch „Wie“ (konkrete Extraktion eines Beispiels). Ziel ist die Generierung einer korrekten Formel, selbst wenn dem Benutzer die tieferen technischen Kenntnisse fehlen.

Das Ergebnis: Der Agent korrigiert die Formel selbständig. Durch das Setzen der Klammern (Capturing Group) werden die Werte nun korrekt extrahiert. Postleitzahlen, die nicht dem Muster entsprechen, bleiben korrekterweise leer (NULL), was die Robustheit der Logik bestätigt.

Dieses Beispiel zeigt, dass eine präzisere Formulierung von Prompts die Wahrscheinlichkeit erhöht, dass der Tableau Agent auf Anhieb korrekte Ergebnisse liefert. Dies ist besonders vorteilhaft, da kein tiefgehendes technisches Wissen erforderlich ist.

Verschachtelung und Fehlerbehandlung

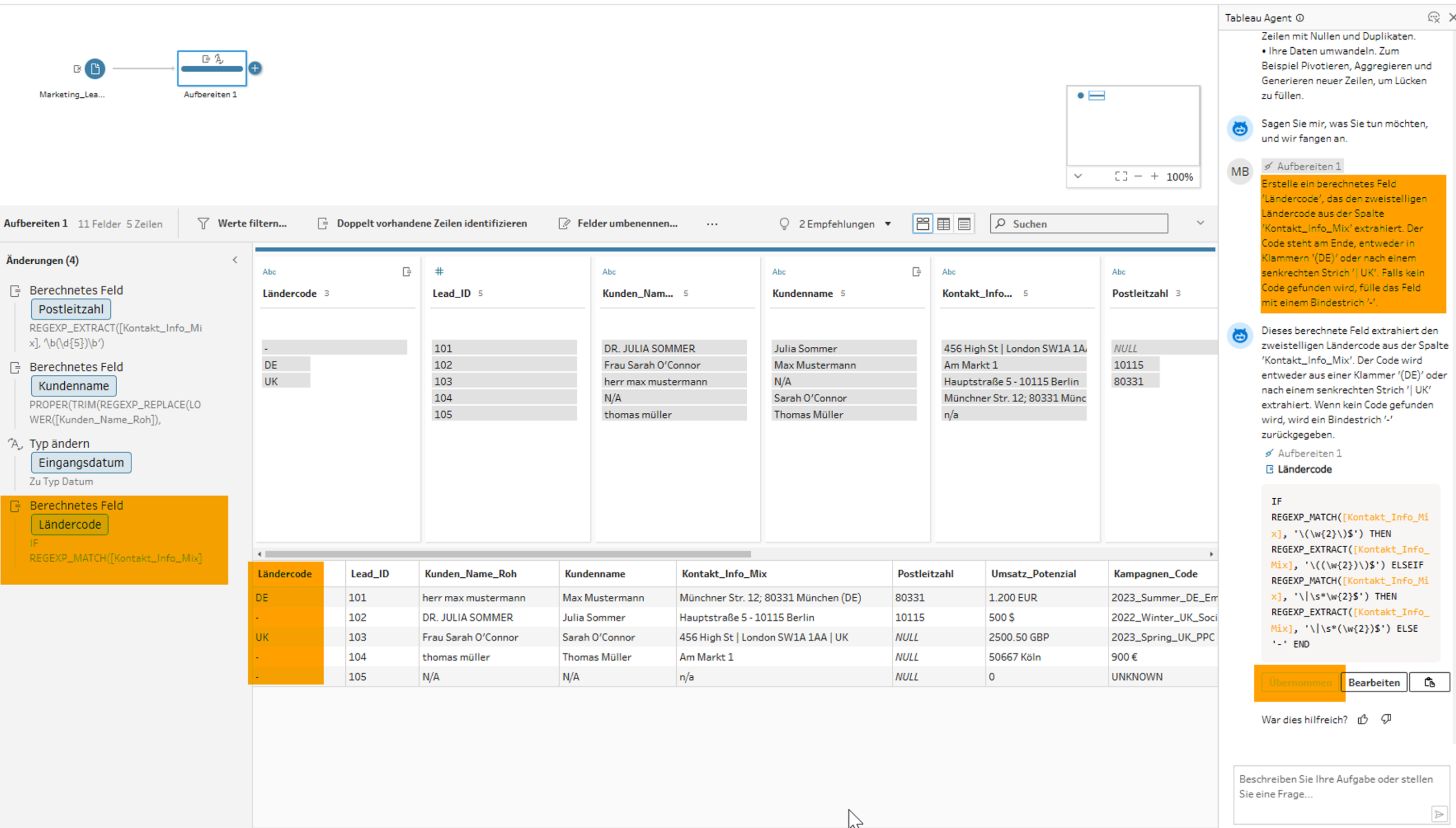

Im nächsten Test testen wir die Fähigkeit des Tableau Agenten, Funktionen zu verschachteln. Wir möchten den Ländercode extrahieren und fehlende Werte direkt durch einen Platzhalter ersetzen. Dies ermöglicht uns nachfolgend die Durchführung von Auswertungen auf Ebene der Länder.

Basierend auf unseren Erfahrungen aus dem ersten Beispiel definieren wir den Prompt so detailliert wie möglich und liefern direkt geeignete Beispiele, um dem Tableau Agenten zu helfen, ein korrektes Ergebnis zu generieren:

Der Agent generiert eine performante und korrekte Kombination aus IF, REGEX_MATCH, REGEXP_EXTRACT. Als Ergebnis werden Ländercodes extrahiert und ein „-“ eingefügt, wenn die Information fehlt. Die KI übernimmt nicht nur die Mustererkennung, sondern auch die korrekte Syntax der Klammern für die verschachtelten Funktionen – eine häufige Fehlerquelle bei der manuellen Eingabe.

Textbereinigung: Mehrere Schritte in einem

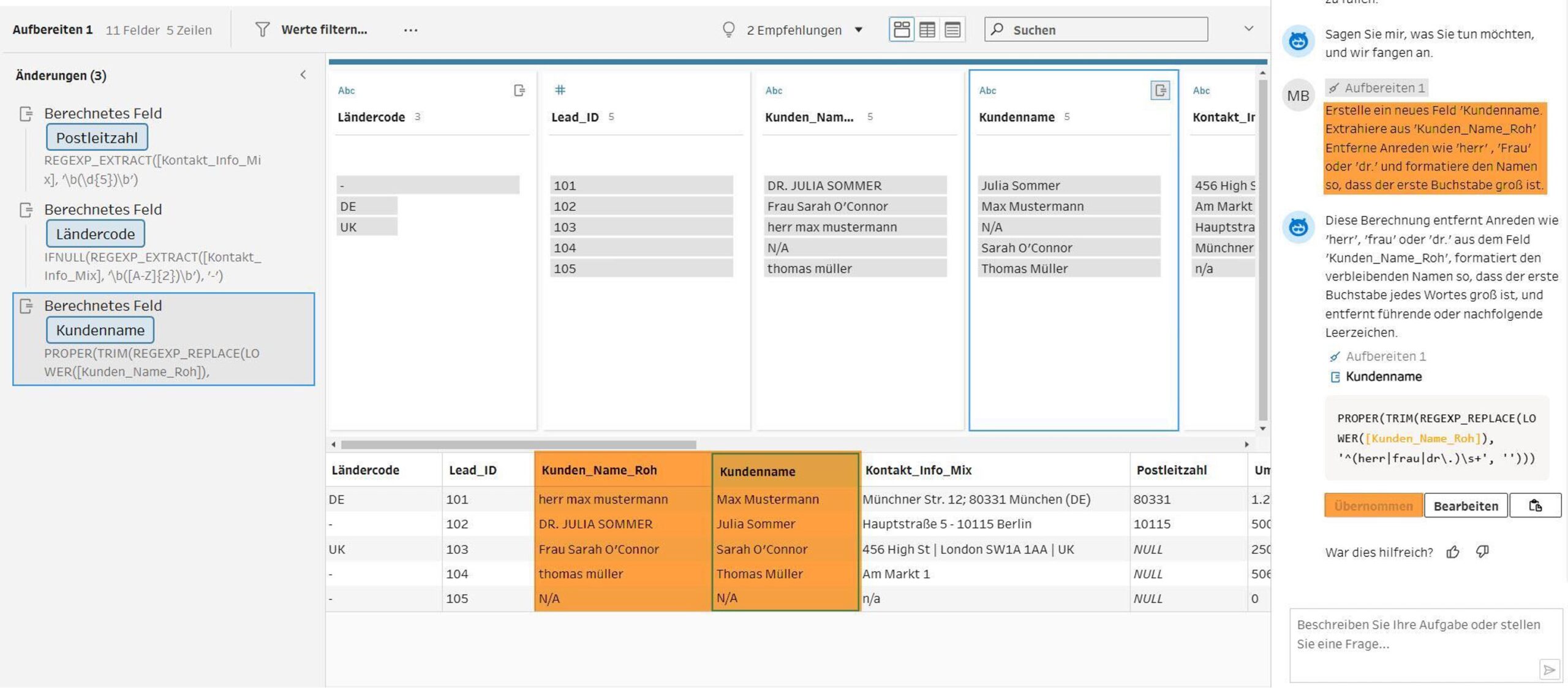

Ein weiteres, gutes Beispiel zeigt sich bei der Bereinigung der Kundennamen, was uns für die strukturierte Analyse auf Kundenebene hilft.

Die Anforderung ist mehrstufig:

- Entferne Anreden (Herr, Frau, Dr.).

- Korrigiere die Groß-/Kleinschreibung (Proper Case).

- Entferne überflüssige Leerzeichen.

Der Agent löst dies mit einer einzigen, mehrfach verschachtelten Formel.

Dies manuell zu schreiben, würde tieferes Verständnis der String-Funktionen erfordern. Der Agent liefert das Ergebnis in Sekunden.

Typisierung

Zum Schluss bitten wir den Agenten, das Textfeld „Eingangsdatum“ in ein echtes Datum zu konvertieren. Dies ist oft bei der späteren Entwicklung von Visualisierungen hilfreich, da native Datumsfelder in vielen Fällen präziser verwendet werden können.

Auch hier erkennt die KI den Kontext und führt die Typ-Konvertierung ohne manuelles Menü-Klicken durch.