Einleitung

Voraussetzungen und technische Umgebung

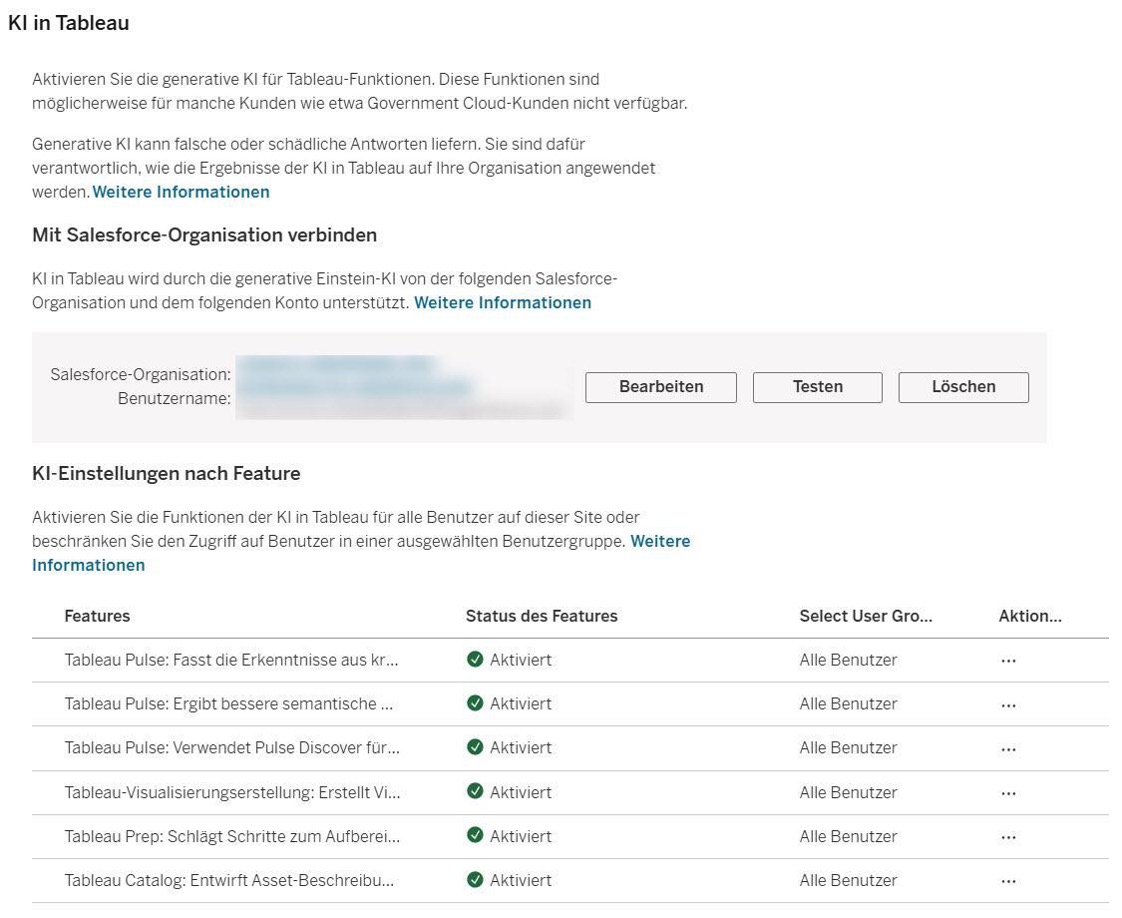

Um die folgenden Schritte in Ihrer eigenen Unternehmensumgebung nachvollziehen zu können, benötigen Sie eine korrekt eingerichtete Tableau Cloud-Umgebung. Im Folgenden betrachten wir, welche Infrastruktur zur Nutzung der hier betrachteten KI-Features vorausgesetzt wird und welche Einstellungen dafür erforderlich sind.

System-Checkliste:

1. Tableau Cloud Instanz: Tableau Pulse steht zurzeit nur in der Tableau Cloud zur Verfügung.

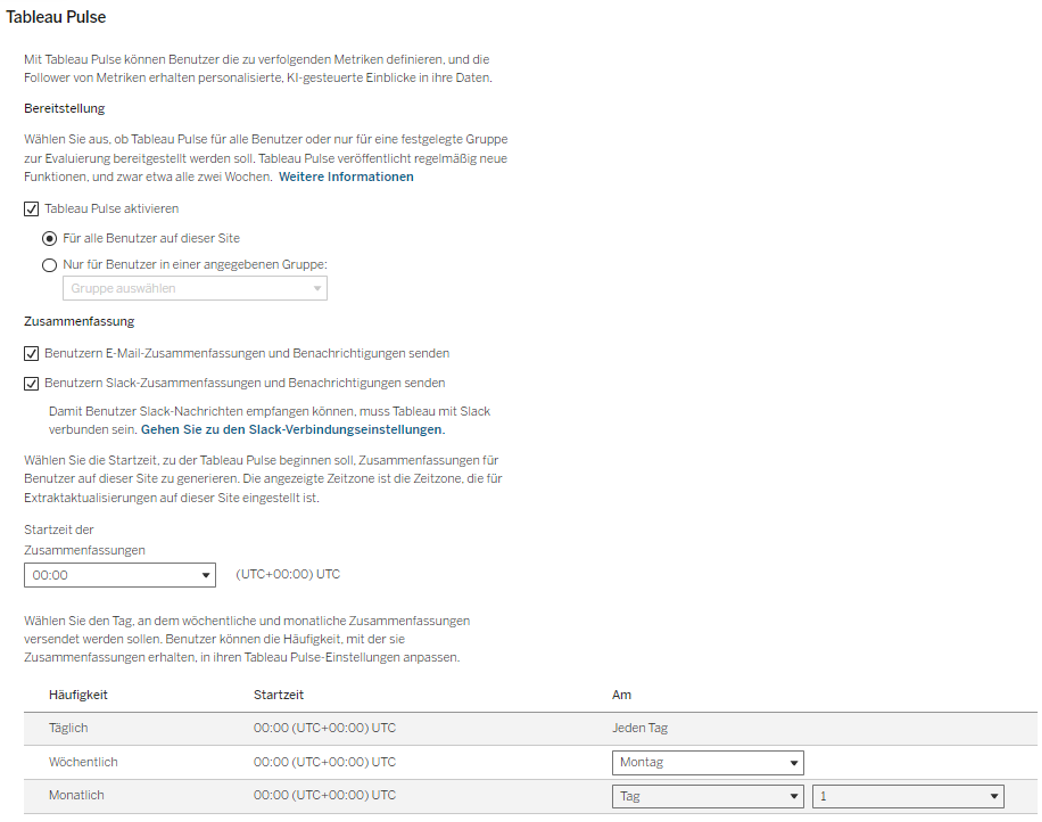

2. KI-Funktionen aktivieren: Die Optionen „Tableau Pulse aktivieren“ und “Tableau Pulse: Fasst die Erkenntnisse aus kritischen Kennzahlen zusammen” müssen aktiviert sein.

3. Datenbasis: Wir verwenden die Beispiel-Datenquelle „Sample – Superstore“, die im Standard von Tableau bereitgestellt wird.

Die Etablierung der Metrik-Definition (Semantic Layer)

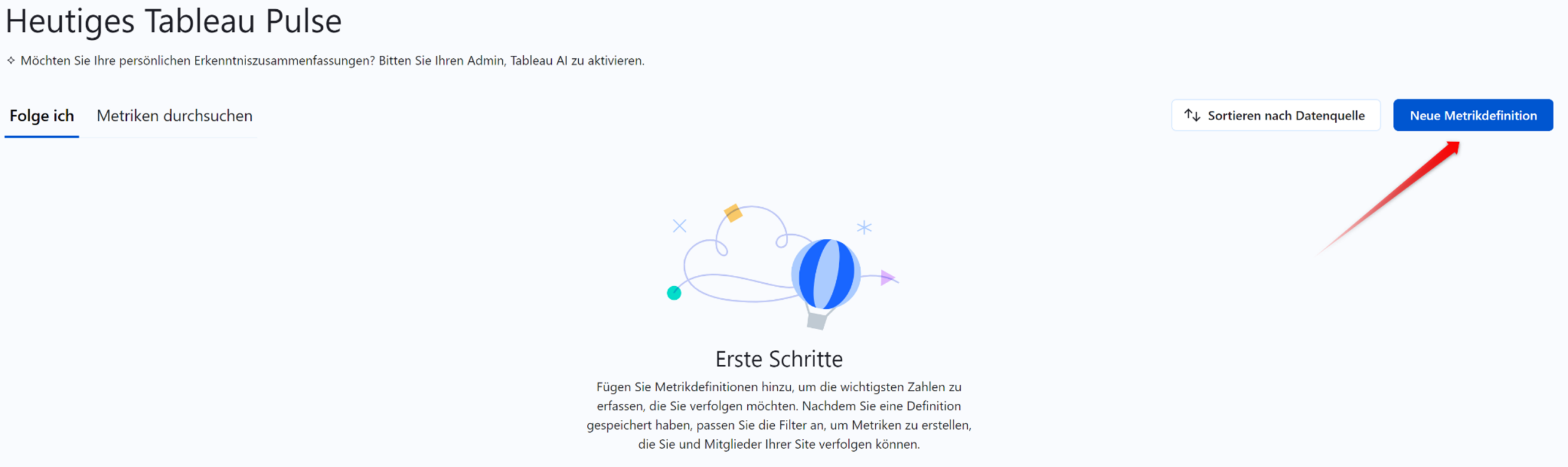

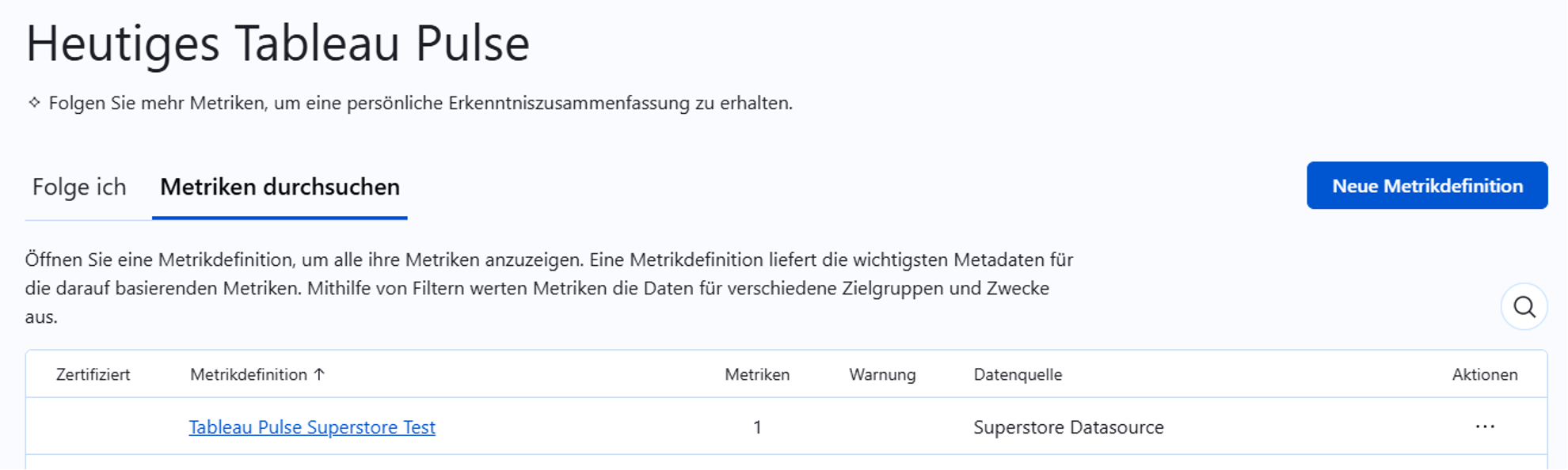

In Tableau Pulse beginnt der Workflow nicht mit einer Visualisierung, sondern mit der Semantik. Wir öffnen die Tableau Pulse Startseite und legen eine „Neue Metrikdefinition“ an. Damit legen wir fest, welche Kennzahl für uns in einem bestimmten Kontext relevant ist. Anschließend liefert uns Tableau auf Basis von KI erweiterte Informationen zu dieser Kennzahl und den mit ihr in Verbindung stehenden Merkmalen.

- Wir öffnen Tableau Pulse, um in das relevante Menü zu gelangen.

2. Wir klicken auf „Neue Metrikdefinition“, um den Prozess zur Erstellung einer neuen Metrikdefinition zu starten.

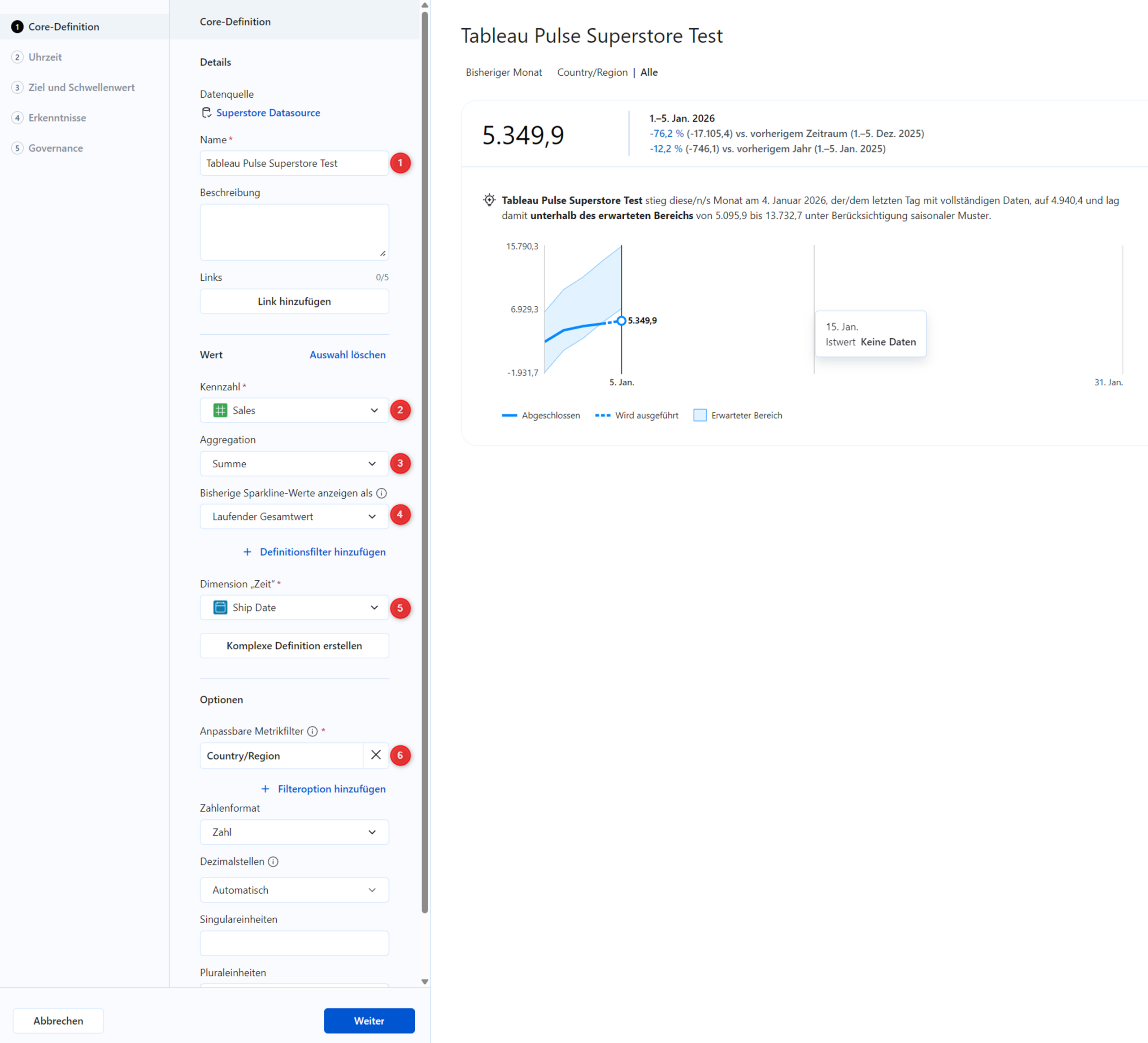

3. Wir erstellen die ”Core-Definition” der neuen Metrik:

(1) Damit die neue Metrikdefinition eindeutig identifiziert werden kann, vergeben wir einen eindeutigen Namen.

Optional: Wir können das “Beschreibung”-Feld für technische Dokumentation (z.B. „Bruttoumsatz vor Retouren“) nutzen. Diese Metadaten werden von der KI genutzt, um Kontext für den Endanwender zu generieren.

(2) Wir wählen die zu analysierende Kennzahl, über die wir Informationen erhalten bzw. verteilen wollen.

(3) Wir selektieren den für den gewählte Kennzahl relevanten Aggregationstyp, d.h. ob Werte der Kennzahl z.B. summiert werden sollen.

(4) Wir legen die Logik für die angezeigte Sparkline-Visualisierung fest, wodurch u.a. Vergleichswerte für unsere Kennzahl bereitgestellt werden.

(5) Wir definieren über welche Zeitdimension (z.B. Rechnungsdatum, Lieferdatum) die Metrik analysiert werden soll

(6) Wir fügen eine oder mehrere Filter hinzu, die durch Benutzer gemäß Ihres Informationsbedarfs angepasst werden können

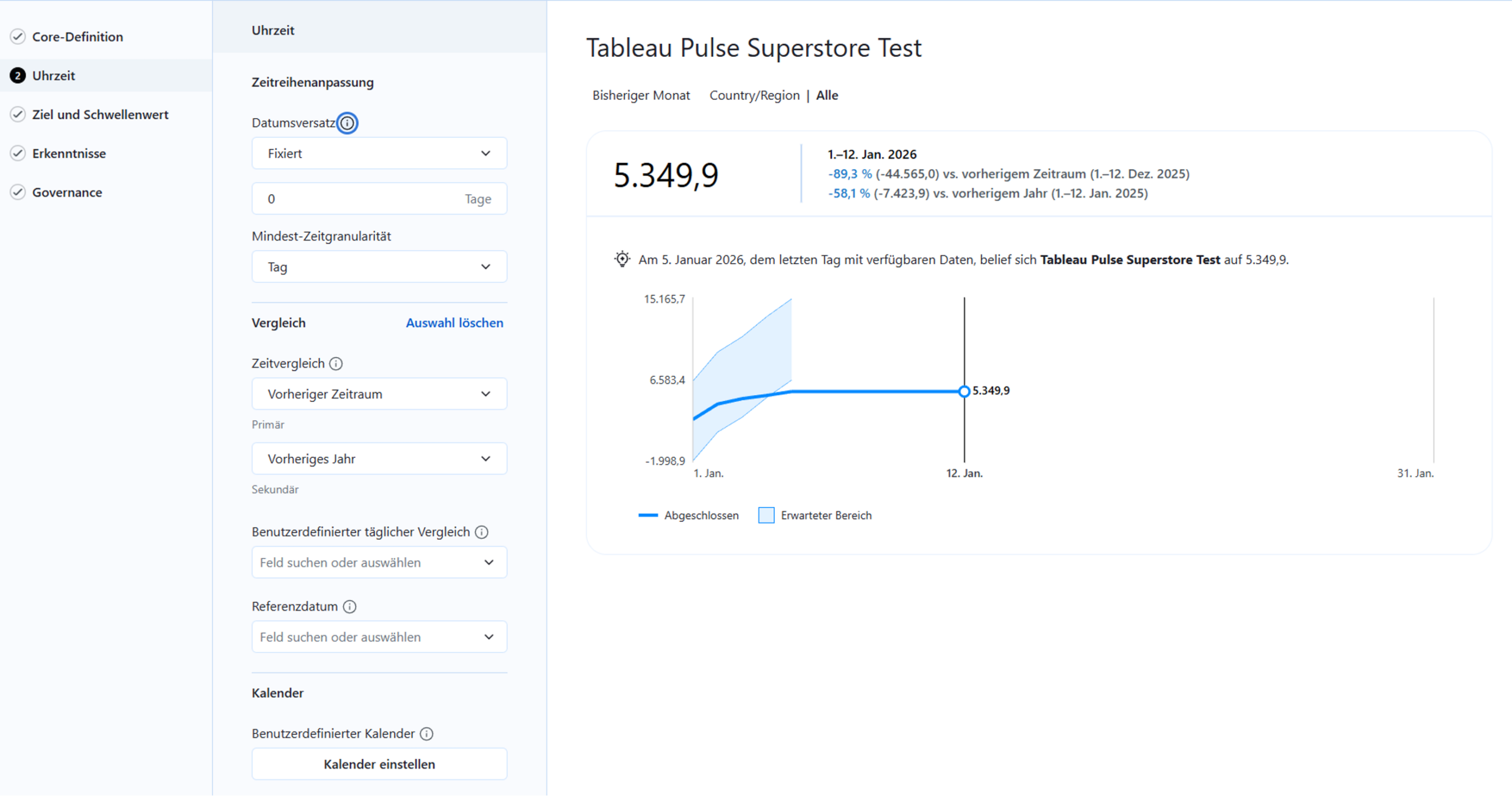

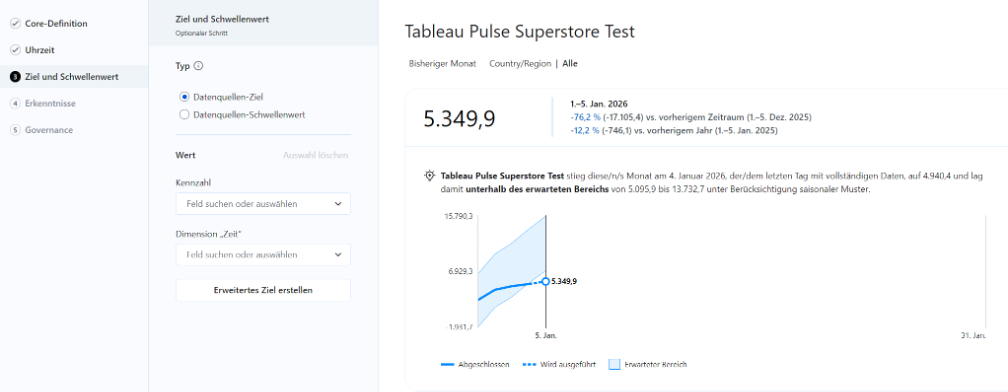

4. Wir verfeinern die Einstellungen für Zeitangaben, Ziel- und Schwellenwerte, um die Metrik weiter zu individualisieren:

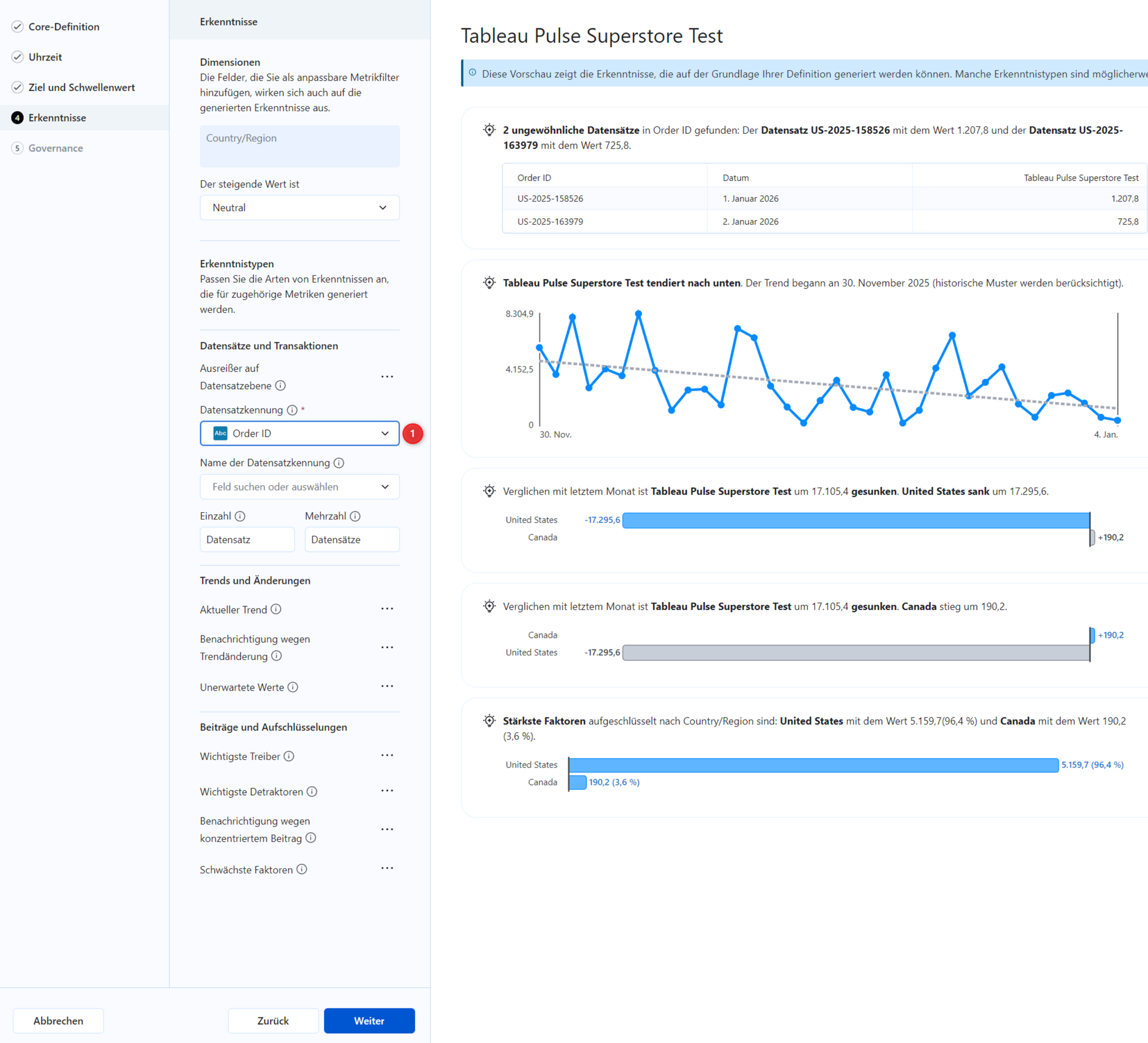

5. Wir legen im “Erkenntnisse” -Menü fest, über welches Merkmal Datensätze eindeutig identifiziert werden können (1). Dies ist insbesondere für die Identifikation von Ausreißern relevant – in diesem Fall von Bestellungen mit einem auffallend geringen oder hohen Umsatz.

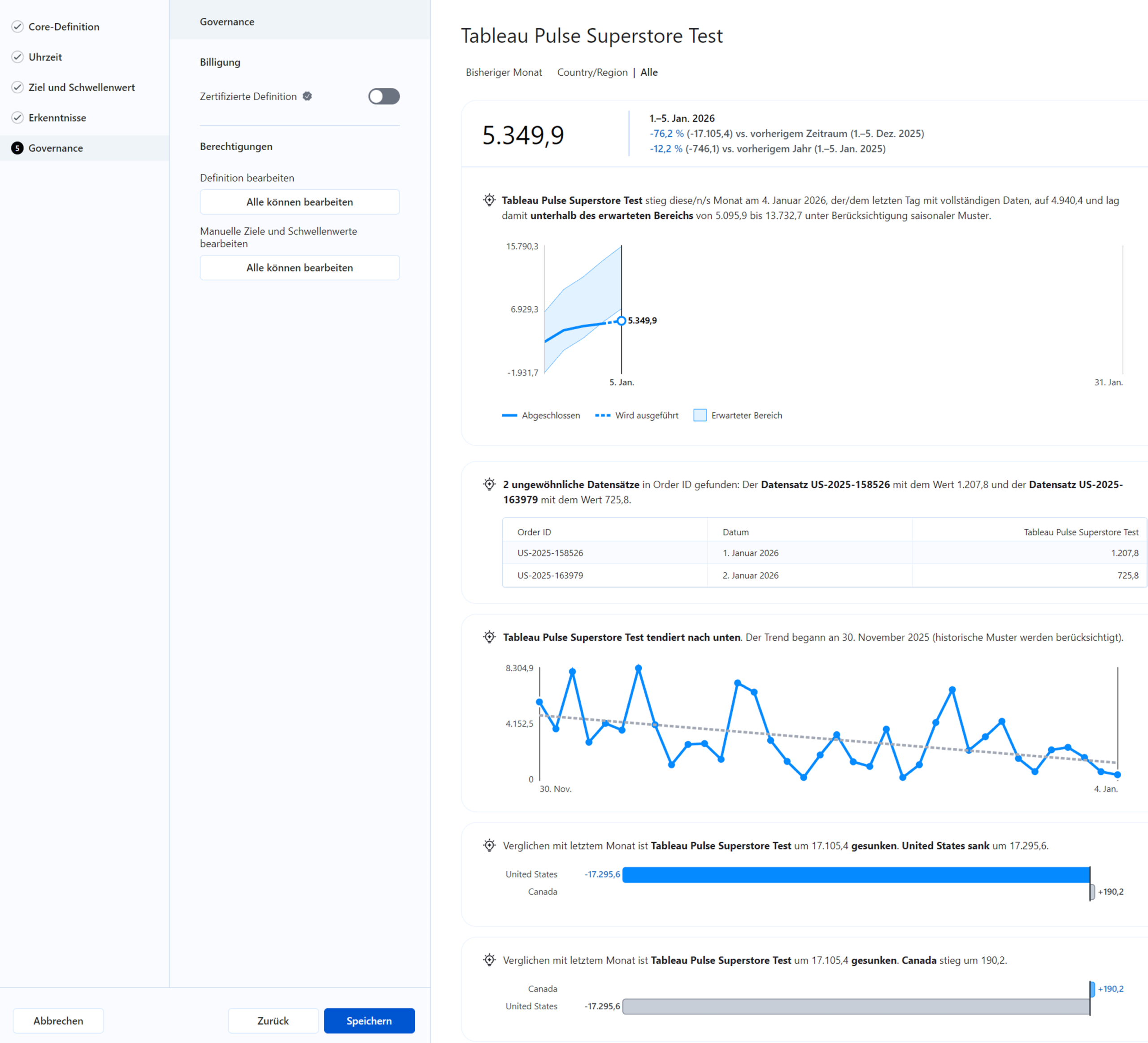

6. Wir können im “Governance”-Menü eine Vorschau der Metrik sehen und definieren, falls nötig, die Berechtigungen, um zu steuern, welche Benutzer Zugriff auf die Metrik haben.

7. Zuletzt betrachten wir das Ergebnis in der Metriken-Liste in Tableau Pulse:

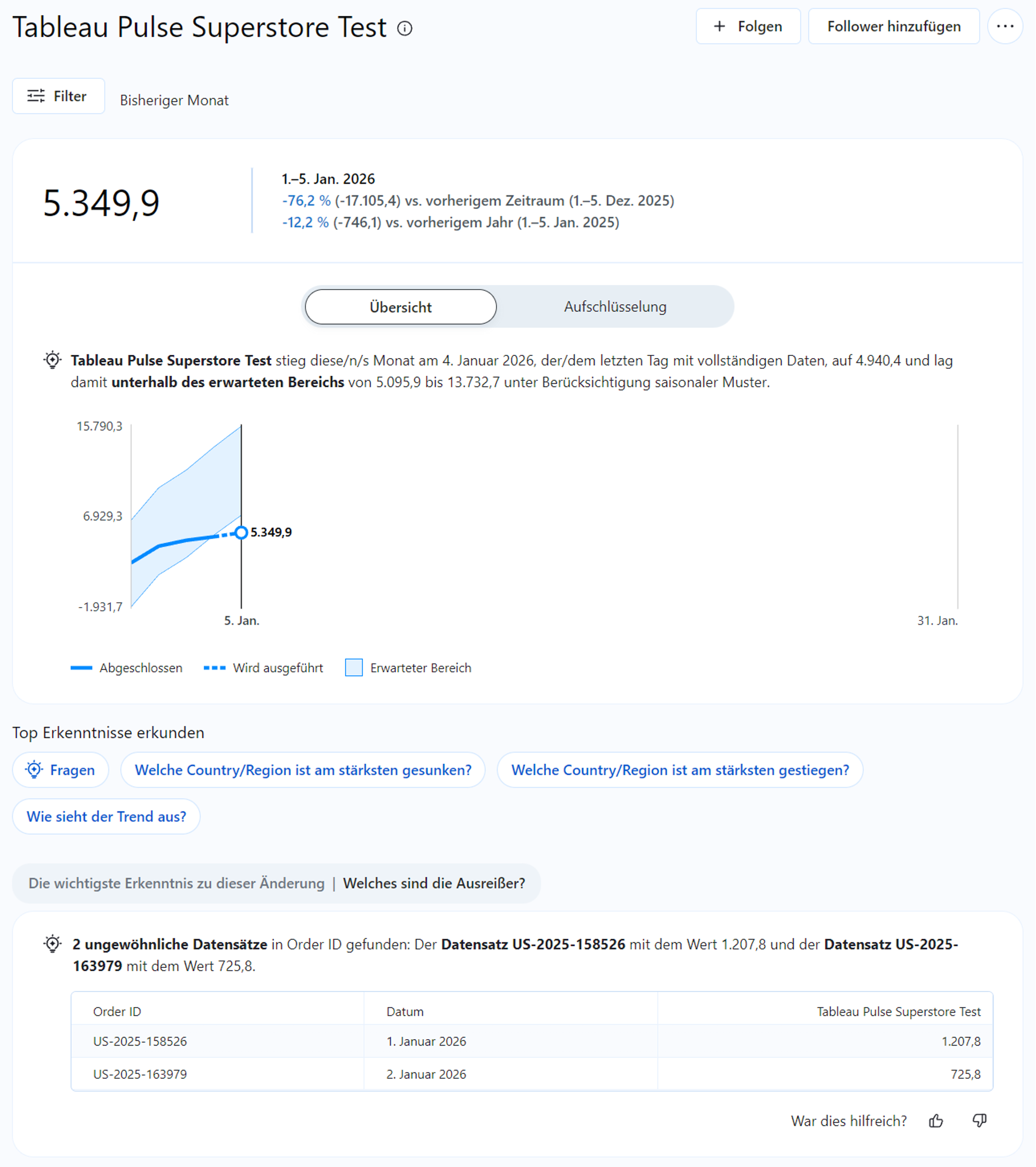

Detailbetrachtung der generierten Metrik

speichern, beginnt die Engine mit der Analyse von Anomalien, Trends und Treibern. Durch diese Konfiguration erzeugt das System automatisch die gesamte Berechnungslogik für Vergleiche (Vorperiode) und Trendanalysen im Hintergrund. Das kann den Aufwand für BI-Teams potenziell enorm verringern, da diese oder ähnliche Analysen nicht erst „manuell“ erstellt werden müssen. Dies ermöglicht es den „Konsumenten“ der analysierten Kennzahl zudem potenziell, neue Abhängigkeiten oder Kausalitäten, welche die Kennzahl beeinflussen, zu erkennen.

Die Detailseite der Metrik – das Ergebnis dieser KI-gestützten Analyse – liefert eine Zusammenfassung der wichtigsten Datenpunkte in natürlicher Sprache.

Das System generiert automatisch Aussagen wie: „Der Umsatz ist um 12% gestiegen, primär getrieben durch die Kategorie ‚Technology‘ in der Region ‚East‘.“

Für IT-Sicherheit und Datenschutz ist entscheidend: Diese Analyse findet innerhalb des sogenannten Einstein Trust Layers statt. Kundendaten werden nicht zum Training öffentlicher Modelle verwendet. Die KI agiert ausschließlich im Kontext der definierten Metrik und gewährleistet Datensouveränität.

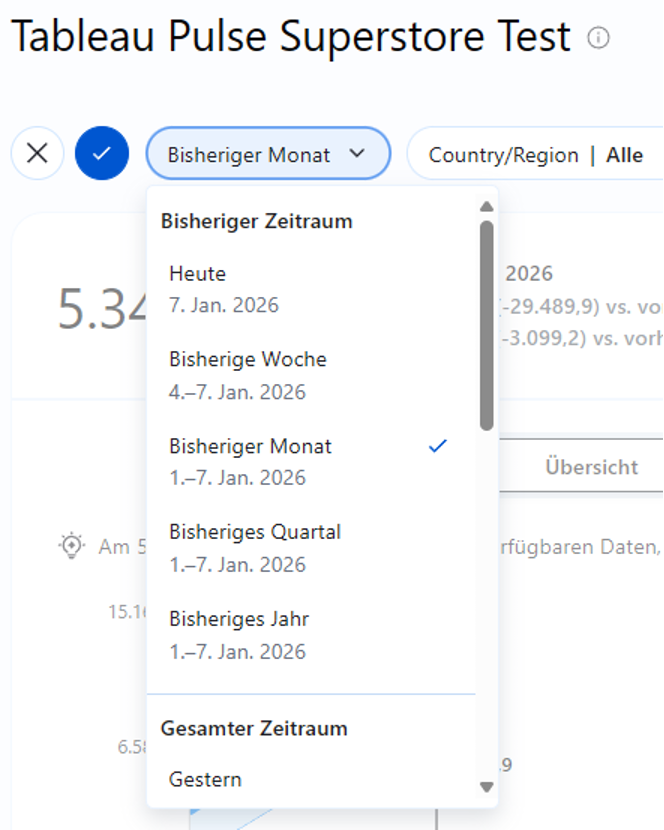

Kontextualisierung durch dimensionale Filter

Moderne BI-Architekturen vermeiden Redundanz. Anstatt einen separaten Bericht für jede Region oder Produktgruppe zu erstellen, können wir in Pulse flexible Filter-Kontexte innerhalb einer einzigen Metrik-Definition festlegen.

Somit kann die Metrik für verschiedene Benutzerkreise individualisiert werden. Ein Regionalleiter sieht beispielsweise dieselbe Metrik-Definition wie der globale Vertriebsleiter, aber standardmäßig gefiltert auf seinen Verantwortungsbereich. Die Daten bleiben konsistent, die Ansicht wird aber individualisiert.

Integration in den Workflow (Mobile & Digest)

Ein weiteres relevantes Thema ist die Verteilung der generierten Metriken. Im „Headless“-Szenario ist das Ziel, die Information genau dorthin zu bringen, wo die Entscheidungsträger arbeiten. Dies vereinfacht die Auswertung der Kennzahlen und erhöht damit die Wahrscheinlichkeit, dass diese auch tatsächlich betrachtet und genutzt werden.

Tableau Pulse verwendet hierfür das „Folgen“/”Follow”-Modell (ein Abonnement-Prinzip):

- Wir klicken auf “Folgen“ (Alternative: Follower werden über “Follower hinzufügen/Add Followers” hinzugefügt) um zukünftig Informationen zu dieser Metrik zu erhalten.

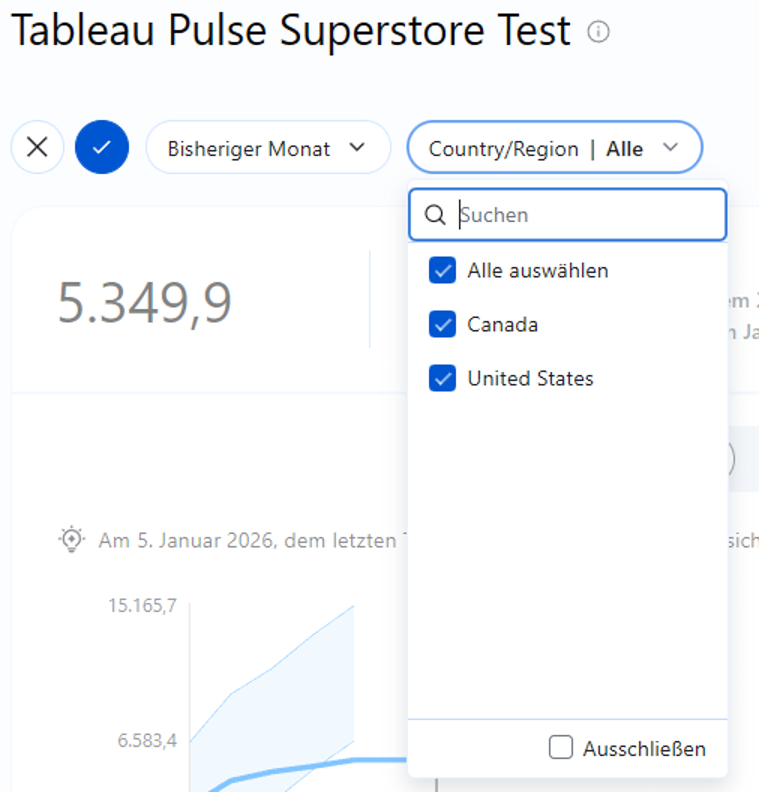

2. Wir definieren, optional, persönliche Filter (z. B. nur „Country/Region”) um die Metrik zu individualisieren.

3. Tableau generiert periodische Zusammenfassungen, die den Benutzern bereitgestellt werden, die der Metrik folgen.

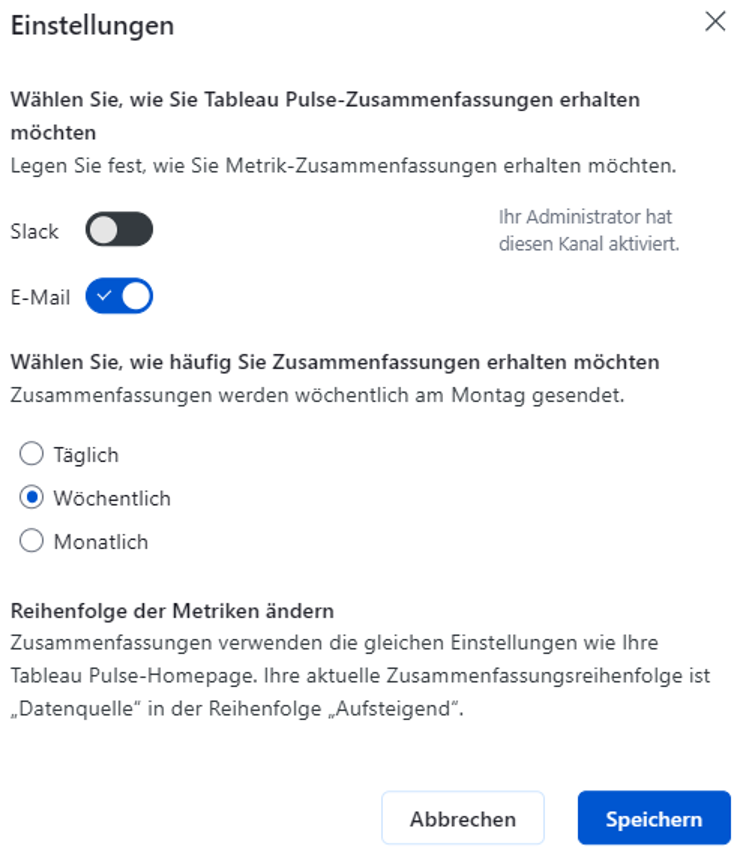

Diese “Digests” (Zusammenfassungen) landen per E-Mail, Slack oder über die Tableau Mobile App beim Nutzer. Sie enthalten nicht nur den aktuellen Wert, sondern auch die KI-generierte Trendbewertung. Das Dashboard wird so vom primären Monitoring-Tool zu einem optionalen Diagnose-Werkzeug für den Drill-Down.

Über ein entsprechendes Einstellungsmenü können wir im Detail festlegen, wie und über welchen Kanal “Digests” bereitgestellt werden sollen – abhängig davon, wann die Kennzahlen von ihren „Konsumenten“ benötigt werden.

In der Metriken-Übersicht können uns zudem eine kurze Zusammenfassung der Metrik anschauen: