Januar 2026

Planung mit Power BI

Einführung

Mit dem Translytical Task Flow stellt Power BI ein leistungsfähiges neues Feature bereit, das es ermöglicht, gezielte Endnutzerinteraktionen direkt in Reports zu integrieren. Dadurch lassen sich klassische, rein analytische Reports zu interaktiven Anwendungen erweitern, in denen Nutzereingaben aktiv in Verarbeitungslogiken einfließen.

In Kombination mit den Microsoft Fabric User Data Functions eröffnet sich erstmals die Möglichkeit, Werte aus Power-BI-Reports heraus kontrolliert in Fabric-Datenbanken zurückzuschreiben. Dieses Rückschreibeszenario stellt ein lang erwartetes Feature vieler Kunden dar und schafft somit die Grundlage für eine Planungsfunktionalität, weshalb das Feature direkt für uns in den Fokus gerückt ist. Die Fabric User Data Functions fungieren dabei als serverseitige, benutzerdefinierte Logikschicht innerhalb von Microsoft Fabric und lassen sich schnell mittels Python Funktion umsetzen. Sie ermöglichen die Validierung, Transformation und persistente Speicherung von Nutzereingaben und bieten zugleich eine saubere Trennung zwischen Frontend (Power BI) und Backend (Fabric). Durch die native Integration in das Fabric-Ökosystem können bestehende Artefakte wie Lakehouses, Warehouses oder andere Datenspeicher direkt genutzt werden und über ein Package von Microsoft werden Werkzeuge für den Entwickler mitgeliefert, die zum Beispiel Fehlerzustände und Validierungsprobleme standardkonform über HTTP-Response-Codes an den Client zurückgeben.

Weiterführende Informationen zu den Konzepten, Einsatzmöglichkeiten sowie den derzeitigen Limitationen des Features finden sich in der offiziellen Microsoft-Dokumentation:

https://learn.microsoft.com/en-us/power-bi/create-reports/translytical-task-flow-overview

In unserem vorherigen Blog

Databricks und Planung oder einfacher Eingabe

haben wir beschrieben welche Anforderungen für Planungsanwendungen ein Tool erfüllen muss, um einfache oder komplexe Planungsszenarien abzubilden. In diesem Blog werden wir prüfen, welche davon mit den neuen Features in Power BI möglich sind und wo die Grenzen liegen.

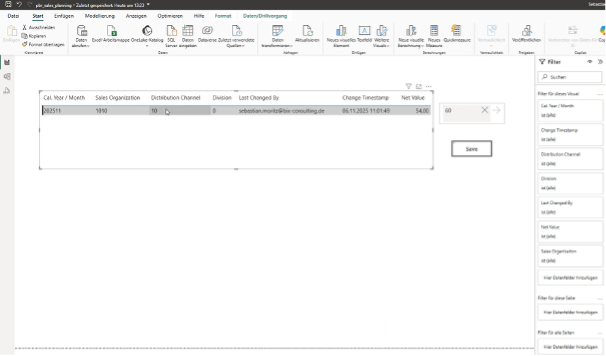

Erfassung über das Power BI–Tool

Abbildung 1: Power BI Layout mit Erfassungsmöglichkeit für ein Feld

Erfassung über Excel

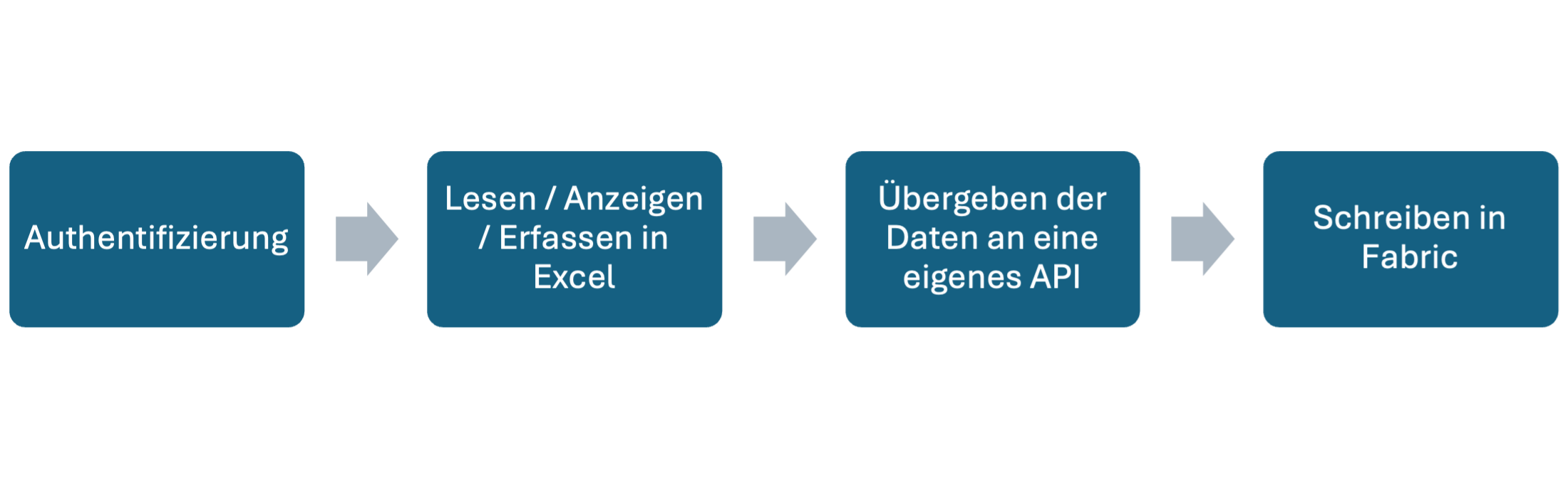

Obwohl Power BI immer mehr Verwendung findet, ist die Planung über Excel als Interface weiterhin sehr beliebt. Neben der Integration in Power BI liefern die User Data Functions auch eine Rest API Schnittstelle, die wir zur Datenübertragung aus Excel verwenden können. Dazu ist zuerst die Authentifizierung zu implementieren. Anders als in anderen Programmiersprachen wie Python gibt es in VBA keine Standard Library von Microsoft, die eine Authentifizierung mit der Microsoft Entra ID abwickelt, weswegen die Authentifizierung an dieser Stelle selber in VBA implementiert werden muss.

Als nächstes wird eine in Fabric implementierte User Data Function benötigt, die die Werte aus Excel entgegennimmt, aufbereitet und dann in eine Tabelle schreibt oder aktualisiert. An dieser Stelle bietet die Database in Microsoft Fabric den präferierten Datenspeicher, weil die Fabric Warehouses derzeit nicht für punktuelle Schreibzugriffe und Updates optimiert sind. Es werden aktuell noch unnötig viele File Operationen im Hintergrund erstellt, was die Performance erheblich beeinflusst.

Abbildung 1: Aktionen zur Erfassung über Excel

Neben der Schreibfunktionalität können weitere benötigte Prüfungen oder Funktionalitäten in die User Data Function implementiert werden. Denkbar wäre beispielsweise die Sicherstellung, dass Zahlen nur in bestimmten Zeiträumen zurückgeschrieben werden dürfen oder gegen eine zentrale Sperre der Planung geprüft werden.

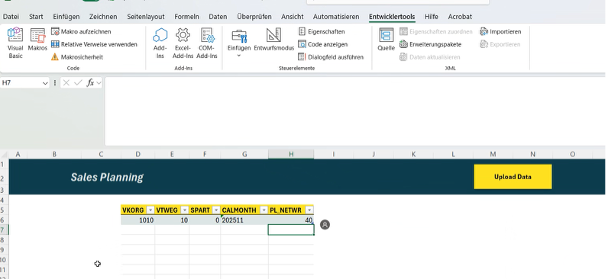

Abbildung 1: Mögliches Layout zur Erfassung über Excel und ein API

Im Gegensatz zu der Verwendung in Power BI, lassen sich mit dieser Lösung bereits ganze Tabellen zurückschreiben und damit eignet sich diese Möglichkeit z.B., wenn die Aufbereitung der Zahlen schon in einer Excel-Arbeitsmappe erfolgt. Alle Funktionen, die während der Erfassung nötig sind, wie z.B. Anzeige von gesperrten Monaten, Berechnungen während der Erfassung müssen im Excel implementiert werden. Funktionen, die erst beim Sichern erfolgen können, können in der User Data Function hinterlegt werden. Generell ist es zu präferieren, den Großteil der Logik zentral in der User Data Function zu implementieren, damit der Code in der Client Applikation nicht manipuliert werden kann und sich Änderungen zentral verwalten lassen. Denkbar ist es auch fundamentale Planungsfunktionalitäten wie das Splash Down in der API zu implementieren und damit den Funktionsumfang der Lösung erheblich zu erweitern. Die Möglichkeiten sind groß, allerdings auch immer verbunden mit Entwicklungsaufwand, während die Standardfunktionalitäten begrenzt bleiben.