Juli 2025

Motivation

Was ist Planung?

Wenn wir untersuchen wollen, ob eine Planung mit Databricks möglich ist, müssen wir zunächst definieren, was Planung ist, bzw. welche Anforderungen für eine Planung an das Tool zu stellen sind. Dabei werden wir feststellen, dass es nicht den einen Planungsprozess gibt und, je nach fachlicher Anforderung, unterschiedliche technische Anforderungen nötig sind. Wir werden dann einzelne Punkte analysieren und unsere Ergebnisse in den folgenden Blogs beschreiben.

Hier ein paar Beispiele von Funktionen, die für verschieden Anforderungen an eine Planung nötig sind.

Einfache Erfassung von Daten

Kombinieren von Anzeige- und Erfassungsspalten

Die Erfassung von Planzahlen neben vorhandenen Ist-Zahlen kommt dem Begriff der Planung schon näher, z.B. wenn die Verkaufszahlen für verschiedene Produkte des vergangenen Jahres vorliegen und die Zahlen für das folgende Jahr geplant werden sollen. Hierfür müssen vorhandene Daten in eine tabelle angezeigt und in einer zusätzlichen Spalte Planzahlen erfasst werden. Dabei ist sicherzustellen, dass der Planer nur in der Planspalte die zahlen erfasst und die anderen Spalten nicht ändern kann. Im Beispiel in Abblidung 1 sind die zu ändernden Zellen farblich hervorgehoben und eindeutig zu erkennen.

Abbildung 1: Beispiel einer einfachen Budgetplanung von Produkten in der SAC mit folgenden Funktionen

1: Kopieren von Ist-Zahlen

2: Erfassung auf einem Hierarchie-Knoten und Verteilung auf Produkte

3: Einfügen einer neuen Zeile, die noch nicht in den Ist-Daten existiert

Verteilung von Planzahlen bei Erfassung von aggregierter Ebene

Stammdaten in der Planung und neue Zeilen

Audit-Merkmale und Eingaben rückgängig machen

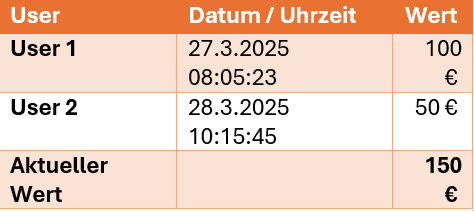

Tabelle 1: Delta – Erfassung mit Zeitstempel

Parallele Planung / Eingaben von mehreren Anwendern

Abbildung 2: Parallele Planung – User 1 und User 2 können ohne Sperre gleichzeitig unterschiedliche Werte ändern und sichern. Beide Änderungen werden berücksichtigt.

Abbildung 3: Parallele Planung – User 1 und User 2 wollen gleichzeitig den selben Wert ändern. Hier muss geklärt werden, wie der Konflikt gelöst wird.

Administration und Steuerung der Planung

Versionierung

Während einer Planung können unterschiedliche Versionen nötig sein. Z.B. beginnt die Budgetplanung mit einer ersten Planung durch die Fachbereiche. Im anschluss wird das gesamtergebnis geprüft, bestimmte Bereiche müssen dann ihre Planung anpassen. Alternativ kann ein optimistisches und ein pessimistisches Szenario erfasst werden. All dies ist in unterschiedlichen Versionen festzuhalten. Diest ist durch ein geeignetes versionskonzept zu unterstützen.

Funktionen für die Initialisierung / Planungsvorbereitung

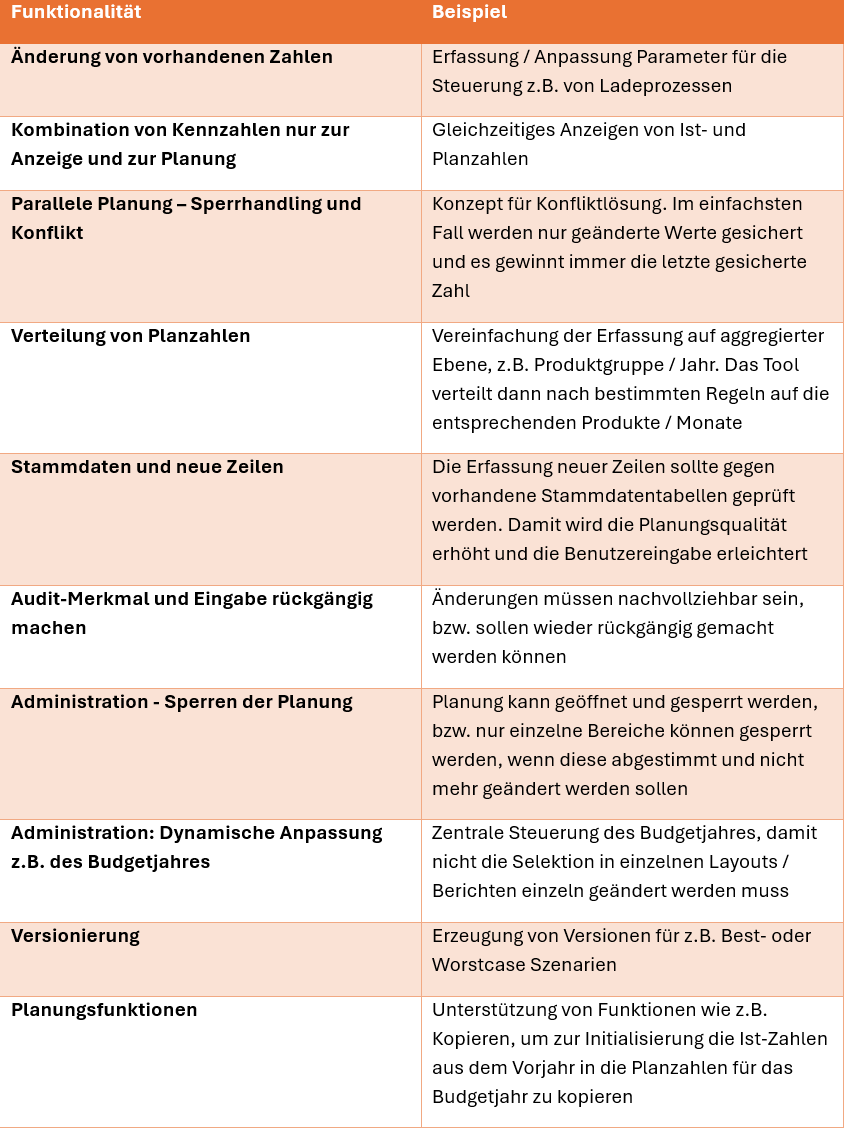

Überblick der Funktionaltitäten

Hier geben wir über alle vorgestellten Funktionalitäten einen Überblick:

Tabelle 2: Überblick der Funktionalitäten