Januar 2025

Parallele Planung in der SAC – Wer wird gewinnen, der Erste oder der Letzte, der seine Daten veröffentlicht?

Hintergrund – Private und öffentliche Version

Wenn ein SAP–Modell im Eingabemodus geöffnet wird, werden alle Daten in eine private Version kopiert. Änderungen werden in dieser privaten Version gespeichert, bis diese veröffentlicht wird.

All das ist gut in dem folgenden Online–Kurs beschrieben:

Viele Fragen zu diesem Thema sind schon in den folgenden Blogs beantwortet:

FAQ: Version Management with SAP Analytics Cloud (Part I – Basics)

FAQ: Version Management with SAP Analytics Cloud (Part II – Versions in Action)

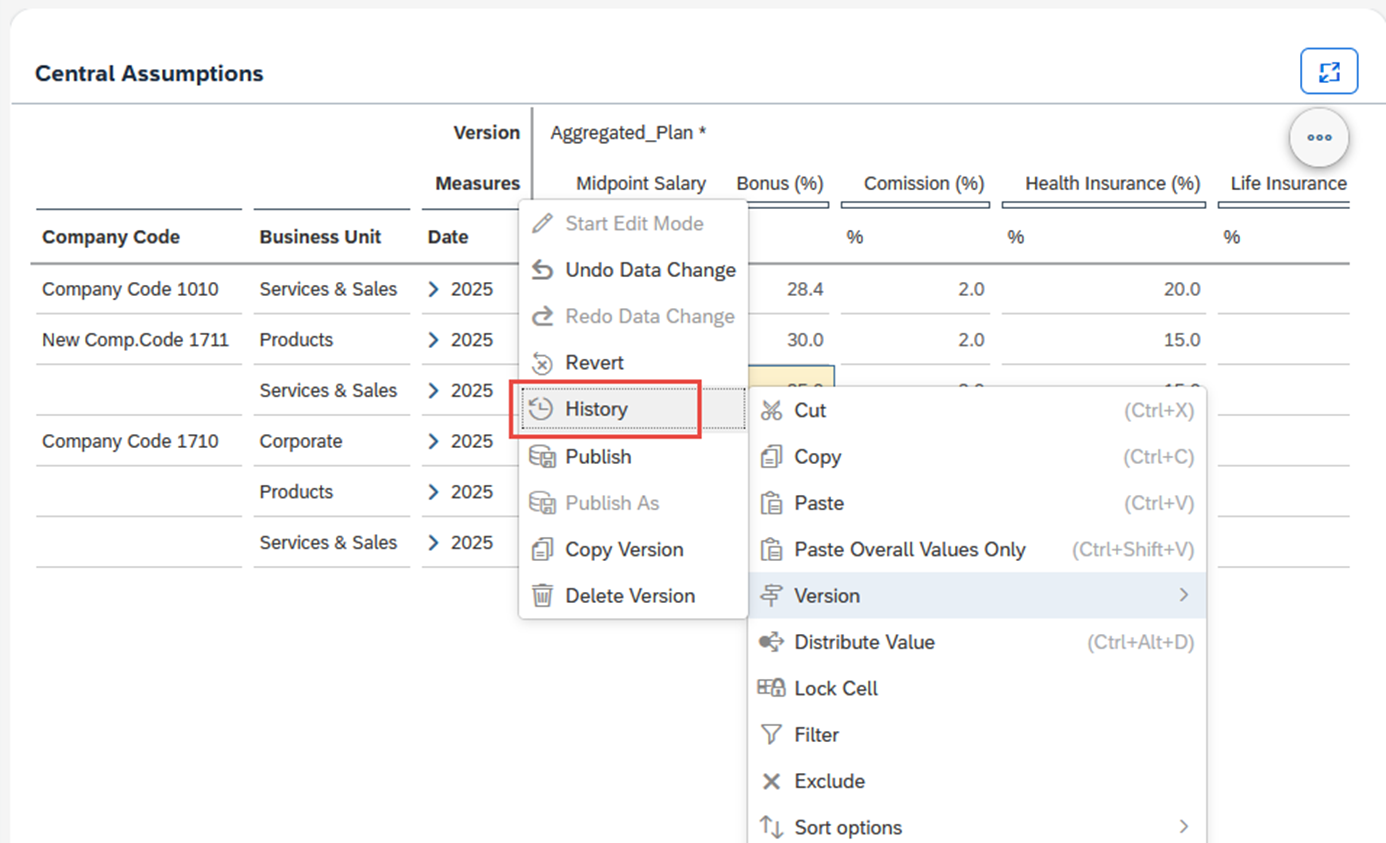

Wie speichert SAP Änderungen und wie kann man diese nachvollziehen?

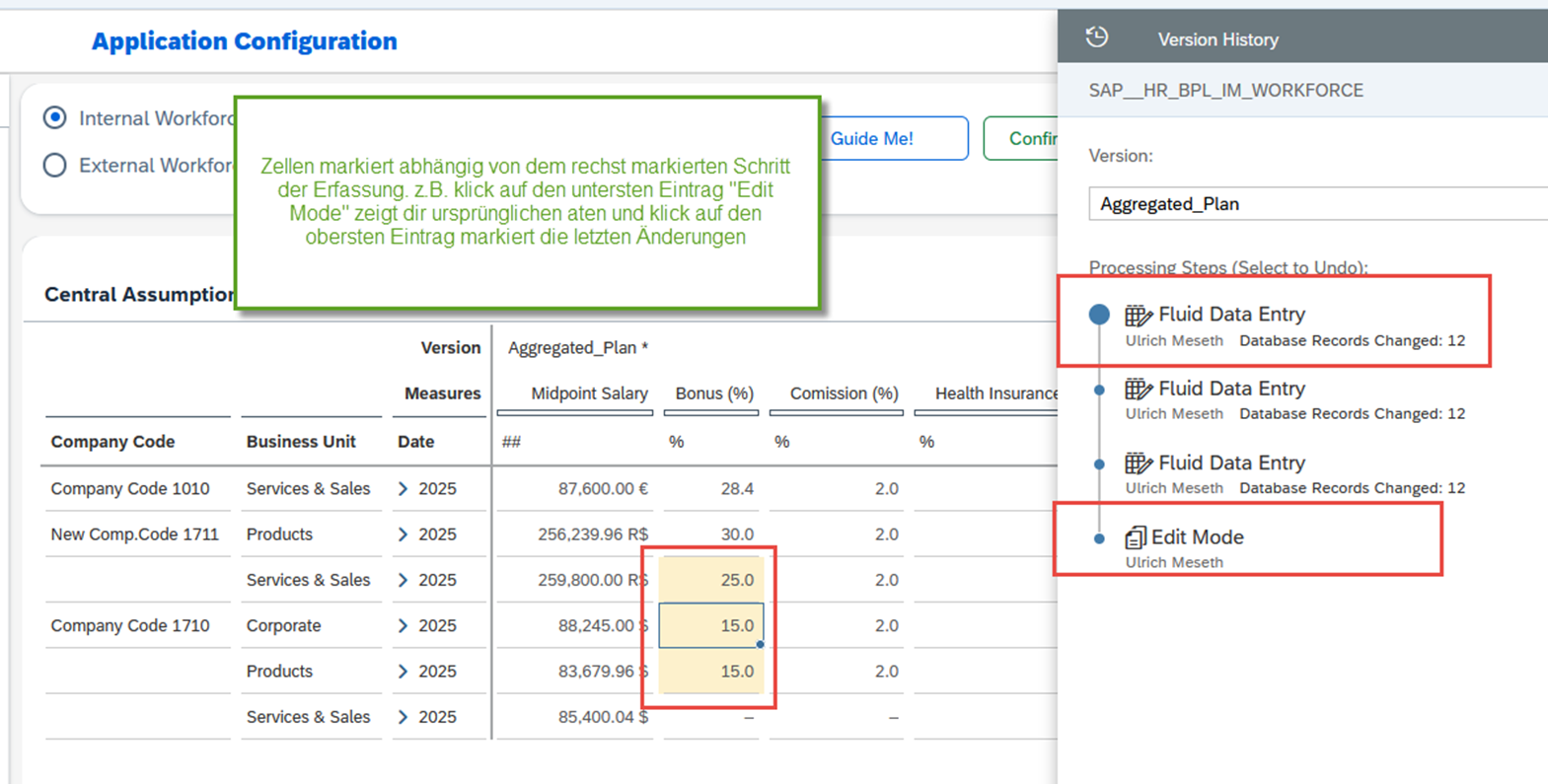

Jetzt sieht man für jeden Eingabeschritt einen „Fluid Data Entry“-Schritt. Abhängig von dem markierten Schritt werden die entsprechenden geänderten Zellen markiert. Hier kann man auch einzelne Schritte wieder zurücknehmen.

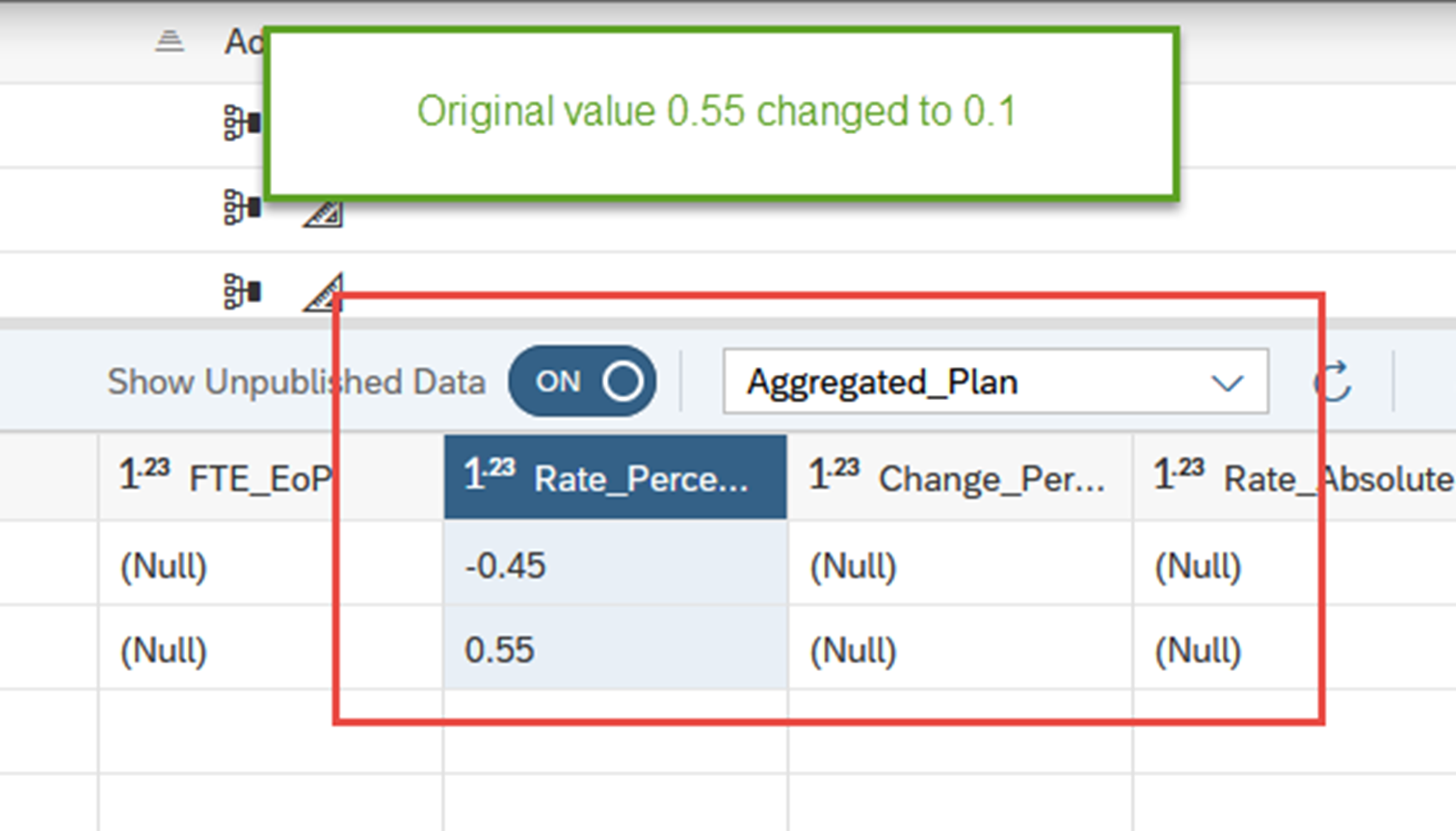

Schauen wir jetzt, wie SAP die Daten speichert. Die Daten können im unteren Bereich mit der Datengrundlage des Modelers angezeigt werden. Dort gibt es einen Schiebeschalter, um unveröffentlichte Daten anzuzeigen. Initial ist dieser Schalter aus und es werden die Daten der öffentlichen Version angezeigt. Wenn man diesen Schalter aktiviert, sieht man für jeden Eingabeschritt eine Zeile mit dem Delta der erfassten Werte. Die aktuelle Planzahl ist also die Summe aller Zeilen für eine bestimmte Selektion.

Man sieht die unveröffentlichten Daten und die Änderungshistorie nur für seinen eigenen User. Es gibt keine Möglichkeit, die unveröffentlichten Daten eines anderen Users zu sehen.

Datenprüfung während des Speicherns

Was macht die SAC nun beim Speichern der Daten?

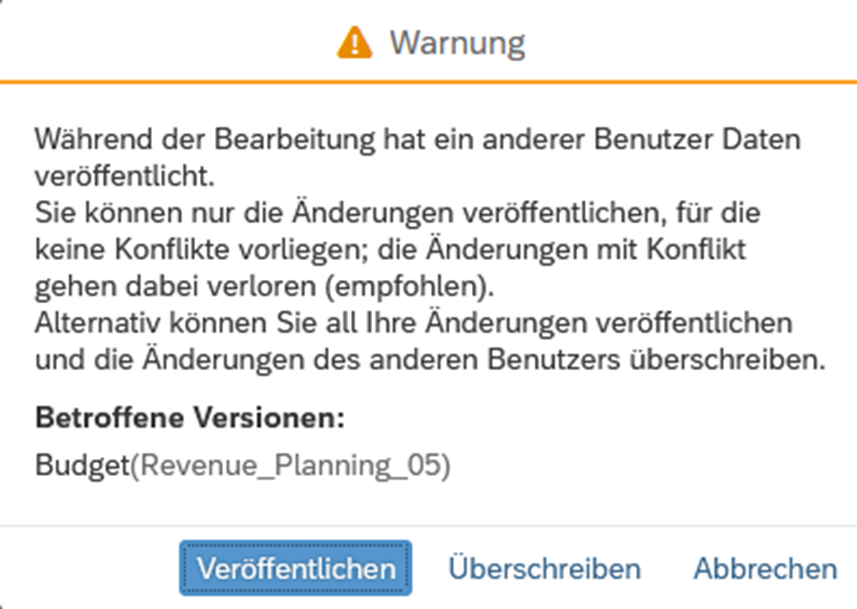

SAP vergleicht die Originaldaten der privaten Version mit der aktuellen öffentlichen Version. Sind diese unverändert, so werden die Daten veröffentlicht. Sind diese inzwischen aber von einem anderen User geändert worden, so muss man sich entscheiden, ob man nur die Änderungen ohne Konflikte veröffentlicht (markiert) oder ob man alle eigenen Änderungen veröffentlicht und die anderen Änderungen überschreibt:

Es gibt keine Möglichkeit, die Merkmalskombinationen mit Konflikten zu identifizieren (oder zumindest haben wir keine gefunden, außer alle öffentliche Werte in einem zweiten Bildschirm mit seinen eigenen Werten zu vergleichen).

Wenn man die Planung nur kurz nach dem Speichern der Änderungen eines anderen Users gestartet hätte, so kann man seine Änderung ohne Warnung speichern und die andere Planung überschreiben. Natürlich ist dies keine wirkliche parallele Planung, aber es mag nur an Sekunden liegen, ob man vor oder nach dem Sichern des Kollegen die eigene Planung startet. Besonders wenn man mit einer Verteilung arbeitet, mag man nicht immer alle Änderungen auf unterster Ebene sofort erkennen.