Einleitung

In diesem Blog-Beitrag werden Ihnen einige Details über SAP-Rollen und Berechtigungen mit Schwerpunkt auf dem BW-Produkt vorgestellt. Rollen werden Benutzern zugewiesen, um ihren Zugang zu T-Codes, Menüs, Berichten, Programmfunktionen und dergleichen zu steuern.

Allgemeines Konzept der SAP-Rollen und Berechtigungen

Zunächst einmal gibt es einige wichtige Transaktionscodes (T-Code) für den Zugriff auf die von SAP bereitgestellten integrierten Tools. Bevor ich auf die Erstellung und Pflege von Rollen eingehe, möchte ich kurz auf die Gründe eingehen, warum wir in einem Data Warehouse Rollen und Berechtigungen benötigen.

In SAP BW-Systemen greifen die Benutzer oft über Abfragen und Berichte, die von erfahrenen Beratern entwickelt wurden, auf Daten zu. Rollen sind jedoch nicht nur dazu da, den Zugriff auf Daten zu beschränken. Sie sind auch für Berater, Entwickler, Programmierer und Basisadministratoren wichtig, die Zugriff auf dasselbe System benötigen.

Beginnen wir mit der Benutzerseite des Ganzen. In einem Unternehmen kann es mehrere Abteilungen geben, z. B. Finanzen und Planung, Vertrieb, Personalwesen, CRM, Logistik und Produktion. Warum sollte ein Kollege aus dem Vertrieb auf Informationen aus dem Finanzberichtswesen oder der Personalabteilung zugreifen dürfen? Um Datenintegrität und -sicherheit zu gewährleisten, müssen wir Rollen und Berechtigungen einsetzen. Eine globale Beschränkung des Zugriffs auf sensible Daten innerhalb eines Systems ist für alle Datendienste unabdingbar, um auch die Gesetze zum Schutz der Verbraucherdaten einzuhalten.

Regeln und Berechtigungen werden jedoch nicht nur zur Einschränkung des Zugriffs auf sensible Daten verwendet. Wir nutzen sie auch, um strukturelle Zugriffsbeschränkungen für die technische Entwicklung und Wartung für SAP-Berater zu ermöglichen, unabhängig davon, ob sie intern oder extern sind. Auf diese Weise können wir eine gemeinsame Grundlage für die technische Entwicklung und eine einwandfreie Laufzeit im SAP BW-Produkt schaffen. Kurz gesagt, wer auf HANA Data Base Level Objekte und Tabellen für READ, WRITE, MODIFY und DELETION oder CREATION Eigenschaften zugreifen darf, wird innerhalb des Systems verwaltet. Auch für andere Objekte wie Berichte, Ansichten, InfoAreas, DataStore-Objekte usw. kann der Zugriff auf Benutzergruppen beschränkt werden.

Es ist wichtig, daran zu denken, dass globale Benennungskonventionen und Berechtigungsregeln von Anfang an gut definiert sein müssen. Andernfalls wird es äußerst schwierig sein, jedes Ticket zu verfolgen, das spezifische Rollen und Berechtigungen von Endbenutzern oder technischen und funktionalen Beratern verlangt. Außerdem gibt es bewährte Praktiken, die man befolgen und Dinge, die man vermeiden sollte.

SAP BW zentrierte Berechtigungen

Beginnen wir mit den Grundlagen in einem SAP BW-System.

Im SAP BW gibt es verschiedene Konzepte für Berechtigungen.

1. Standard Berechtigungen: Diese basieren auf dem SAP-Standardberechtigungskonzept. Sie werden von allen Benutzern benötigt, die Daten modellieren oder laden und die Zugang zur Planungsworkbench oder zur Definition von Abfragen benötigen.

2. Analyse Berechtigungen: Diese basieren nicht auf dem SAP-Standardberechtigungskonzept. Sie werden für Benutzer benötigt, die sich Bewegungsdaten aus berechtigungsrelevanten Merkmalen für Queries anzeigen lassen wollen.

SAP BW zentrierte Rollen

Bei den Rollen können wir in 3 verschiedene Typen denken.

1. Einzelne Rollen

2. Abgeleitete Rollen

3. Zusammengesetzte Rollen

Berechtigungsobjekte können Benutzern oder Rollen zugewiesen werden. Es ist einfacher, den Berechtigungsprozess zu kontrollieren und zu pflegen, wenn die Objekte den Rollen und die Rollen den Benutzern zugewiesen werden.

So erstellen Sie ein neues Berechtigungsobjekt

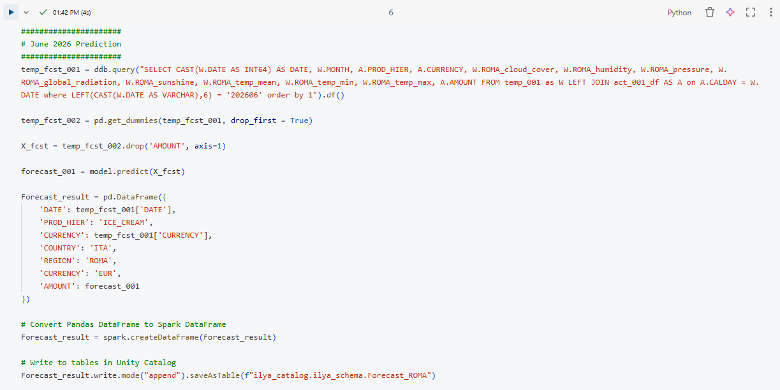

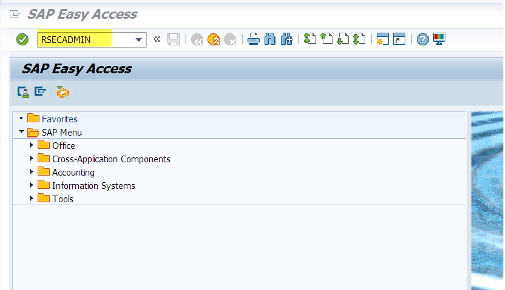

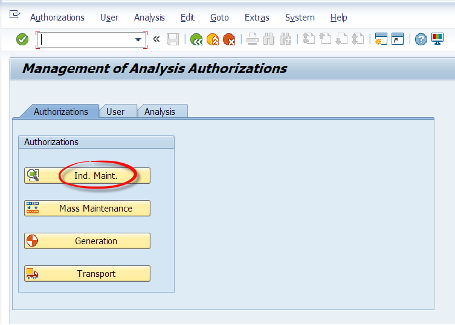

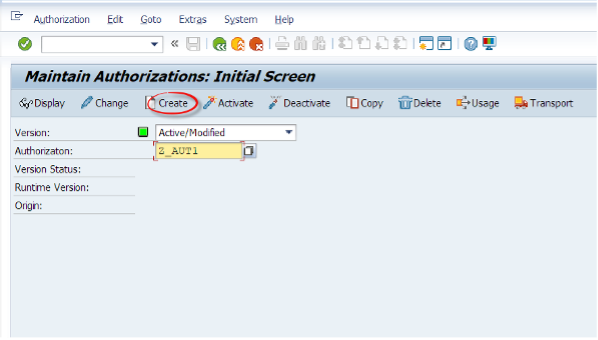

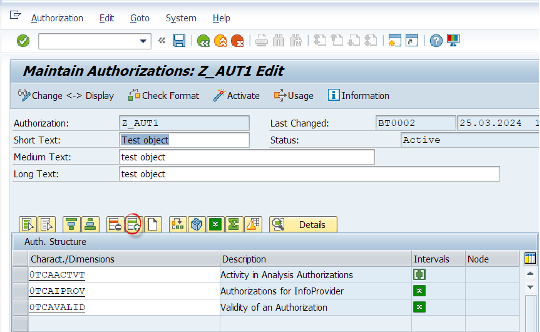

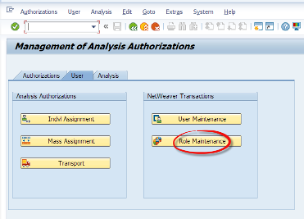

Wir geben den T-Code RSECADMIN ein und klicken dann auf die Registerkarte Berechtigungen. Dann klicken wir auf Ind. Instandhaltung. Dann klicken wir auf die Schaltfläche Erstellen und geben unserem neuen Objekt den Namen Z_AUT1.

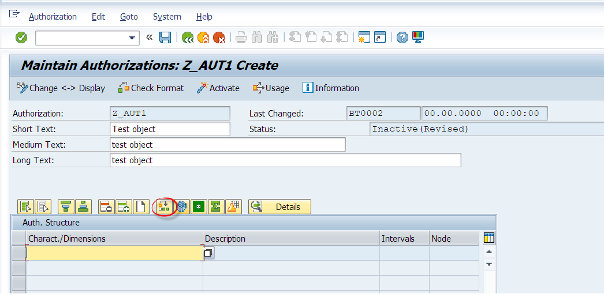

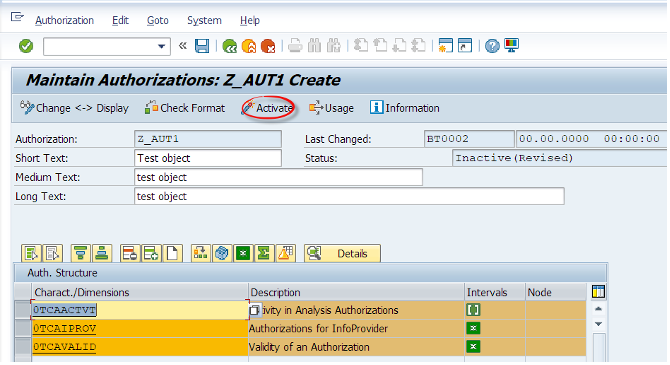

Dann werden wir dieser Liste vordefinierte spezielle Berechtigungsmerkmale hinzufügen. 0TCAACTVT (Aktivität), 0TCAIPROV (InfoProvider) und 0TCAVALID (Gültigkeit).

Ein Benutzer muss mindestens ein zugewiesenes Berechtigungsobjekt haben, das diese Merkmale enthält. Andernfalls kann er keine Abfragen ausführen. SAP empfiehlt, diese Merkmale aus Gründen der Transparenz zu jedem Berechtigungsobjekt hinzuzufügen, auch wenn dies nicht zwingend erforderlich ist.

In der Voreinstellung sind die Werte in den Intervallen:

-Standard: Lesen (03)

-Gültigkeit: immer gültig (*)

-InfoProvider: Alle (*)

-Für Änderungen an Daten: Ordnen sie zusätzlich die Aktivität Ändern (02) zu.

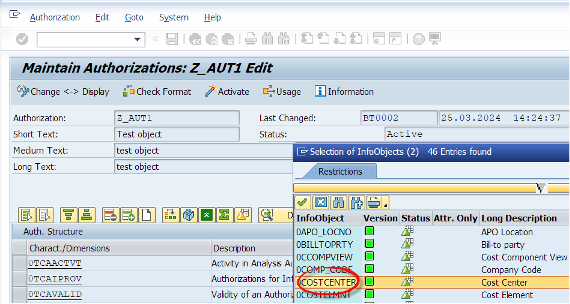

Fügen wir eine Zeile hinzu, wie unten gezeigt, und wählen ein Merkmal aus, das sich auf die Berechtigungen bezieht.

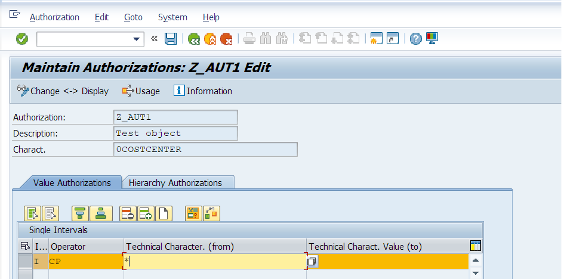

Jetzt haben wir 0COSTCENTER zu unserem Berechtigungsobjekt hinzugefügt, das über das Zeichen * Zugriff auf alle Kostenstelleneinträge hat.

Wie können wir dieses Berechtigungsobjekt einem Benutzer zuordnen?

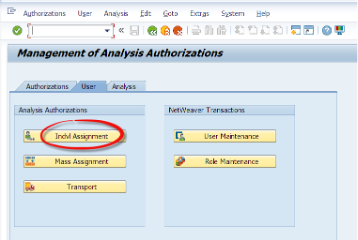

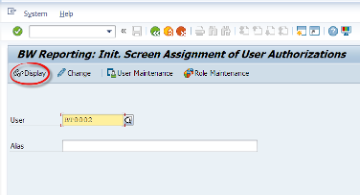

Gehen wir zu RSECADMIN T-code. Unter der Registerkarte Benutzer klicken wir auf die Schaltfläche Indvl. Zuweisung.

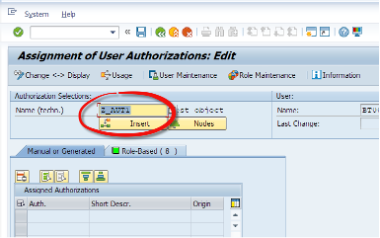

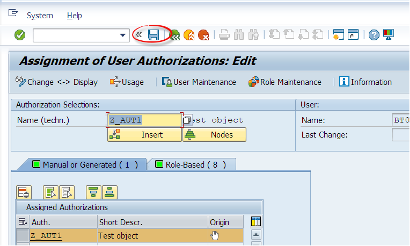

Nachdem wir den Benutzernamen eingegeben haben, klicken wir auf die Schaltfläche Ändern. Wir geben den technischen Namen des Berechtigungsobjekts ein, das wir erstellt haben. Dann können wir auf die Schaltfläche Einfügen klicken, um dieses Objekt manuell zum Benutzer hinzuzufügen. Dann klicken wir auf die Schaltfläche Speichern.

Wie bereits erwähnt, ist dies nicht der bevorzugte Weg. Schauen wir uns die andere Möglichkeit an.

Wir werden dieses Objekt einer Rolle zuweisen – Erstellen wir zunächst eine Rolle.

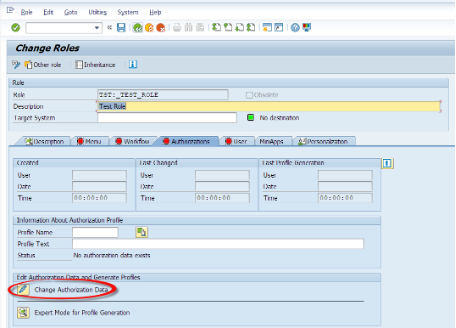

Wie erstellen wir eine Rolle im SAP BW?

Kommen wir nun zur Rollenerstellung. Wir haben Berechtigungsobjekte, die wir Rollen oder Benutzern zuweisen. Wir können die Rollen auch den Benutzern zuweisen, was die Verwaltung vereinfachen könnte.

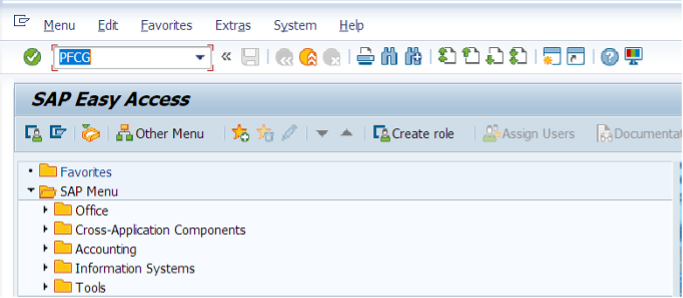

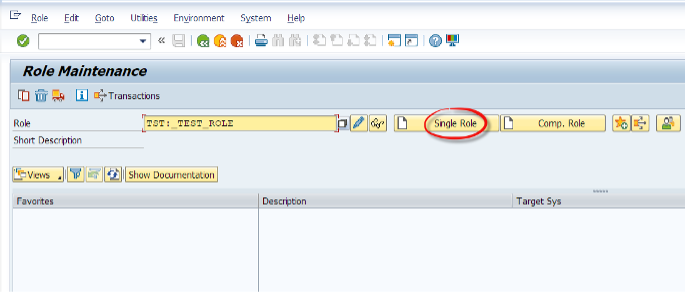

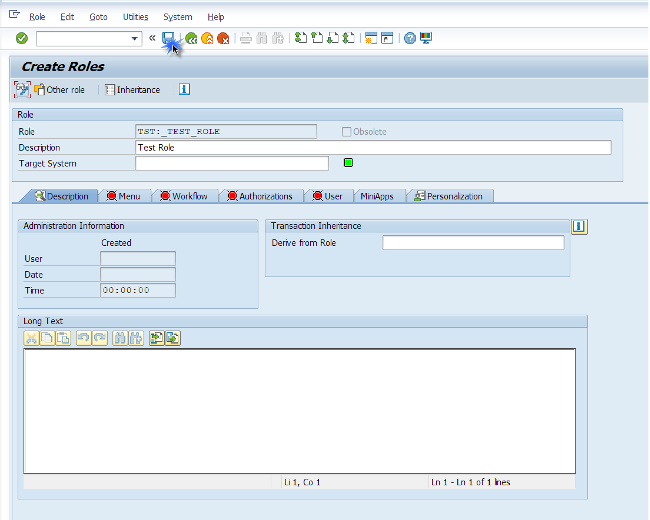

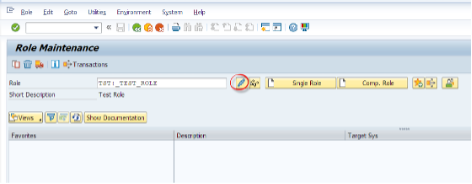

Jetzt können wir RSECADMIN oder PFCG verwenden, um eine Rolle zu erstellen.

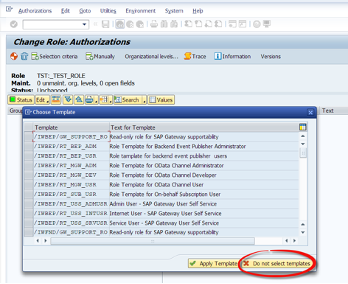

Eine Systemabfrage fragt, ob wir generische Vorlagen anwenden wollen. Der Einfachheit halber werden wir diesen Vorgang überspringen.

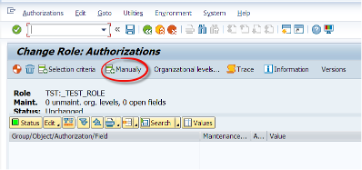

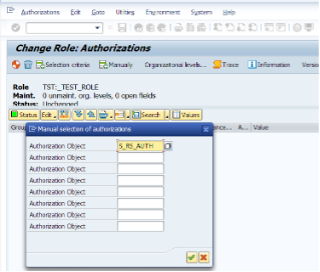

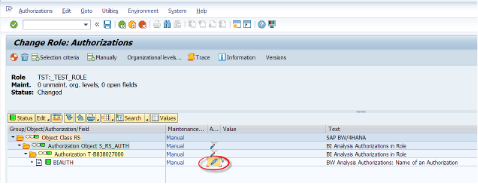

Es gibt ein Systemobjekt zum Speichern von Analyseberechtigungsobjekten, das S_RS_AUTH heißt. Jedes Berechtigungsobjekt, das wir erstellen, muss unter diesem Objekt gespeichert werden.

Wir werden dieses Objekt manuell unserer benutzerdefinierten Rolle zuweisen. Anschließend weisen wir diese Rolle dem Benutzer zu, um die Verwaltung der Sicherheit zu erleichtern.

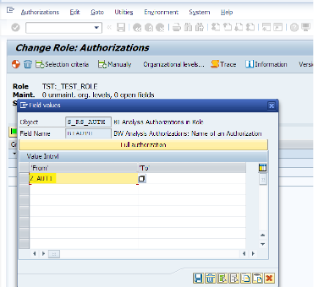

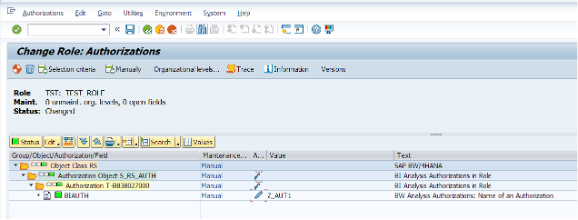

Jetzt fügen wir das Berechtigungsobjekt hinzu, das wir zuvor unter dem Objekt S_RS_AUTH erstellt haben.

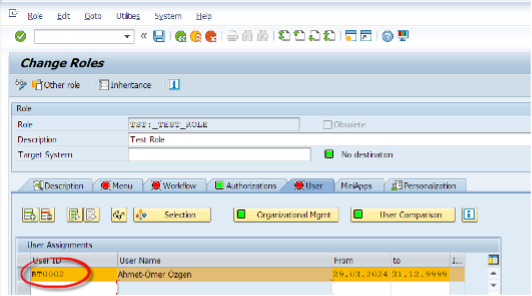

Wir Weisen dem Benutzer eine Rolle zu

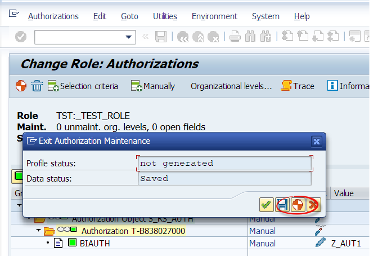

So erzeugen Sie das Berechtigungsprofil

Bevor wir die Zuordnung zur Rolle speichern, müssen wir das Berechtigungsprofil generieren. Dazu benötigen wir als Voraussetzung die Berechtigung S_USER_PRO in unserem Benutzer.

Was die SAP sagt: “Sie müssen Berechtigungsprofile generieren, bevor Sie sie Benutzern zuweisen können. Für jede Berechtigungsstufe in der Browser-Ansicht wird eine Berechtigung generiert und ein Berechtigungsprofil für die gesamte Rolle, wie sie in der Browser-Ansicht dargestellt ist.“

Wenn Sie auf die Schaltfläche Generieren klicken, wird das entsprechende Berechtigungsprofil erstellt.

Anmerkungen

Hinweise: Wenn wir einer Rolle Berechtigungsobjekte zuweisen, die wir nicht kennen, können wir auf die Schaltfläche Auswahlkriterien klicken. Wenn wir auf die roten Minus-Symbole klicken, verwandeln sie sich in grüne Plus-Symbole, und wir klicken auf die Schaltfläche Ausgewählte einfügen, die sie der Rolle hinzufügt.

Wir können Berechtigungsobjekte hinzufügen, die Benutzern den Zugriff auf Info Cubes, ADSOs oder verwandte BW-Objekte ermöglichen. Wir können den Benutzerzugriff auf LESEN, ÄNDERN usw. im Teil * Aktivität unter dem hinzugefügten Berechtigungsobjekt ändern.

Erstellt im Mai 2024