Dezember 2025

Einleitung

Live Connection in Seamless Planning – Was ist das?

Einen guten Überblick über Seamless Planning liefert dieser Blog:

Understanding Seamless Planning

Live Connection in Seamless Planning ermöglicht das Verknüpfen von weiteren Tabellen / Views mit meinen Planzahlen, ohne diese in das Datenmodell mit den Plandaten zu kopieren. Diese Funktionalität ist in folgendem Blog von Maximilian Gander sehr gut beschrieben:

Unlocking the Next Chapter of Seamless Planning in SAP Business Data Cloud with Live Versions

Ebenso gibt es eine ausgezeichnete Schulung / Demo dazu, die auf der TechEd 2025 gezeigt wurde. Den Link zu dieser Schulung und weitere Highlights stehen in diesem Blog:

TechEd 2025 in Berlin – Recap on planning in SAP Business Data Cloud

Die Einrichtung einer Live-Verbindung gestaltete sich unkompliziert. Dennoch sollten folgende Punkte berücksichtigt werden, die grundsätzlich aus dem Konzept hervorgehen:

- Es ist nur möglich Fact-Views einzubinden

- Eine Live-Version kann/muss mit einer leeren/neuen Version verbunden werden. Sind schon Daten für dies Version im Modell vorhanden, kann diese nicht mit Live-Daten verbunden werden.

- Es kann nur eine Version als „actual/Ist“ markiert werden. Daher ist es nicht möglich, einen Teil der Ist-Daten sowohl in das Modell zu kopieren als auch einen anderen Teil live zu verknüpfen oder die Ist-Daten aus zwei Live-Verbindungen zu beziehen. Dazu muss man dann Versionen verwenden, die nicht als „ist“ markiert sind oder vorher alle Ist-Daten in einem einzigen View zusammenfassen.

- Alle Dimensionen der Live-Daten MÜSSEN mit einer Dimension des Datenmodells verknüpft sein. Solange eine Dimension der Live-Daten nicht verknüpft ist, kann man das Modell nicht sichern. Überflüssige Dimensionen sind vorher in dem View innerhalb von Datasphere auszublenden. Wenn der Live-View nicht alle Dimensionen liefert, ist dies dagegen kein Problem.

- Es kann immer nur EINE Version einem Live-View zugeordnet werden. Daher ist es nicht möglich, die Dimension „Version“ zuzuordnen! Der View muss immer auf eine Version gefiltert sein!

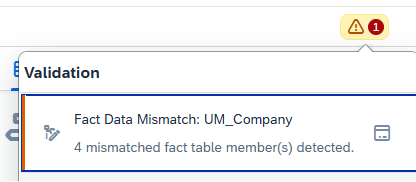

- Fehlen Stammdaten in den SAC-Tabellen, die in dem Live-View vorkommen, so wird dies im SAC-Modell angezeigt. Die Stammdaten können einfach über Knopfdruck ergänzt werden (s. Screenshots)

Abbildung 1: Fehlermeldung bei fehlenden Stammdaten

Abbildung 2: Popup, um fehlende Stammdaten zu ergänzen

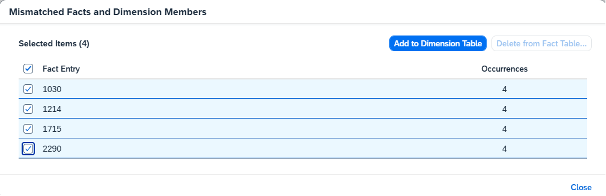

Abbildung 3: Version mit Herkunft bei Live-Versionen

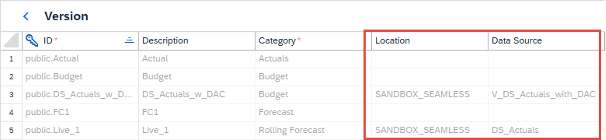

Welche Möglichkeiten bietet die neue Funktionalität?

Abbildung 4: Möglichkeiten mit Live Connection in der Seamless Planung

Wie spielen SAC und Datasphere-Berechtigungen bei Live Connections zusammen?

Bei Seamless Planning liegen die Daten in der Datasphere, es wird aber alles von der SAC verwaltet.

Wie sieht dies nun bei den Berechtigungen aus?

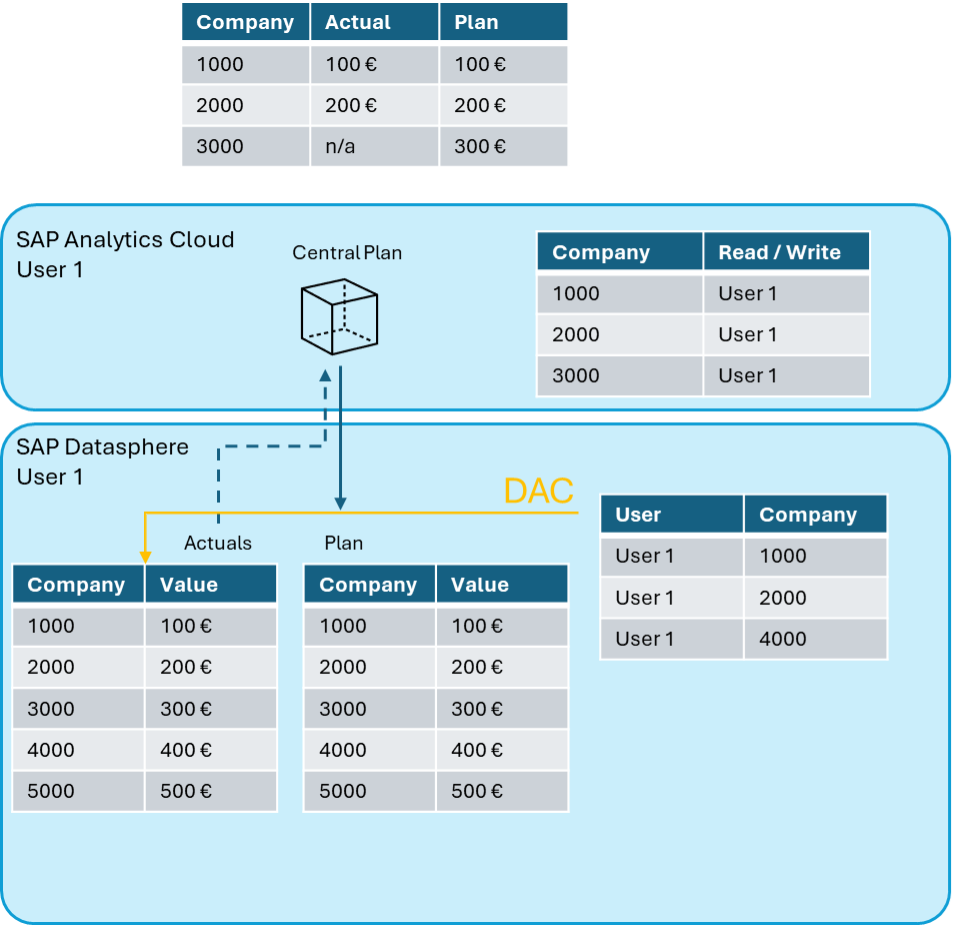

- Der User benötigt die Berechtigung in der SAC, um auf die Planung zugreifen zu können.

- Hat der User keine Berechtigung in der Datasphere (entweder gar keinen User oder keinen Zugriff auf den entsprechenden Space) dann kann er die SAC-Planung ausführen, sieht aber keine Daten, die über das Live-Modell eingebunden sind. (s. Abb. 5)

- Ist eine Dimension in dem SAC-Modell als berechtigungsrelevant markiert, dann schränkt diese die Daten in der SAC sowohl für die Planungsdaten als auch für alle Live-Modelle ein. (s. Abb. 6)

- Achtung, die Einschränkungen in der SAC gelten nicht für die Daten in der Datasphere! User, die auf die Plandaten in der Datasphere direkt zugreifen können, haben diesen Zugriff erst einmal ohne die SAC-Einschränkungen! Hierfür sind auch in der Datasphere getrennte Einschränkungen (DAC) zu implementieren und synchron zur SAC-Berechtigung zu halten.

- Gibt es in der Datasphere Einschränkungen über ein „data access control“ für den User, so gelten diese auch, wenn die Daten über eine Live Connection in ein Planungsmodell eingebunden sind. (s. Abb. 6)

Abbildung 5: SAC User ohne Datasphere User oder Space Berechtigung: Planung geht, aber Live-Daten fehlen!

Abbildung 6: DAC – Berechtigung in der Datasphere und Einschränkung in der SAC

-> beides gilt für die Live-Daten, Plandaten verwenden nur die SAC-Einschränkung

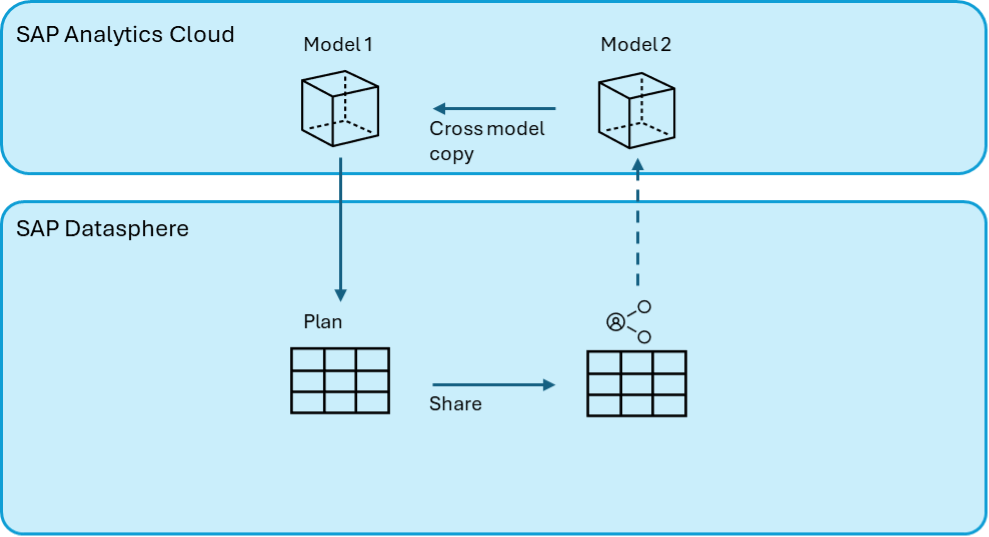

Ist eine Selbstreferenz zu den Plandaten möglich?

Abbildung 7: Selbst referenzierendes virtuelles Datenmodell über zweites SAC-Modell möglich