Einleitung

Seit geraumer Zeit hat SAP ihre Lösung für „Integrierte Planung (IP)“ in BPC (Business Planning and Consolidation) „umbenannt“. Entwickler, die von IP kamen, konnten die zusätzlichen Funktionen, die sich aus der Integration von BPC ergaben (wie BPC-Modelle), gut ignorieren, solange sie im BW blieben und nur die ursprünglichen IP-Funktionen verwendeten.

SAC wird immer beliebter, und mehr und mehr IP-Lösungen werden SAC als Frontend nutzen. Das ist großartig und funktioniert im Prinzip ohne jegliche Einschränkung. Sie müssen „nur“ ein BPC-Modell hinzufügen. Dies ist keine große Sache und schnell implementiert. Aber in einigen Situationen war dies nicht so einfach wie erwartet.

In diesem Blog möchten wir unsere wichtigsten Erkenntnisse mit Ihnen teilen:

- Erinnerung an die Verwendung von BPC-Modellen und wie man sie am besten testet

- Probleme bei der Stammdatenplanung

- Was muss in einem Modell sein -> alle Composites, die in einer Planungssequenz verwendet werden

Bevor wir diese Themen erläutern, wollen wir mit einem kurzen Überblick über die Umstellung von BPC auf SAC beginnen.

Was ist zu tun, um BPC-Lösungen über SAC zu betreiben?

Wenn Sie damit beginnen, SAC als Frontend zu nutzen, ist es großartig, dass Sie die bestehenden BPC-Planungslösungen in Ihrem BW-System weiter nutzen und mit reinen SAC-Planungslösungen kombinieren können.

Dies ist in dieser Blogserie sehr gut beschrieben:

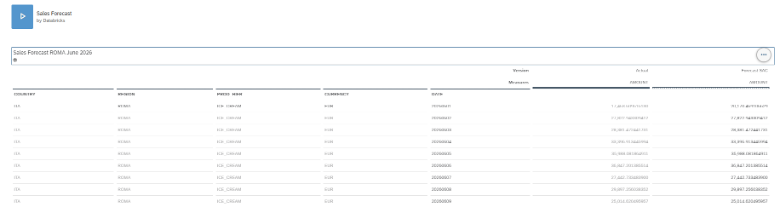

Die einzige Funktionalität, die wir bisher in SAC nicht gefunden haben, ist das Anlegen neuer Stammdaten über eine eingabebereite Query. Dieser spezielle Fall und mögliche Lösungen sind bereits in unserem Blog beschrieben:

https://www.bix-consulting.com/de/stammdatenpflege-in-bw-bpc-und-sac/

Kleiner Unterschied zwischen der Verwendung von AfO als Schnittstelle und SAC:

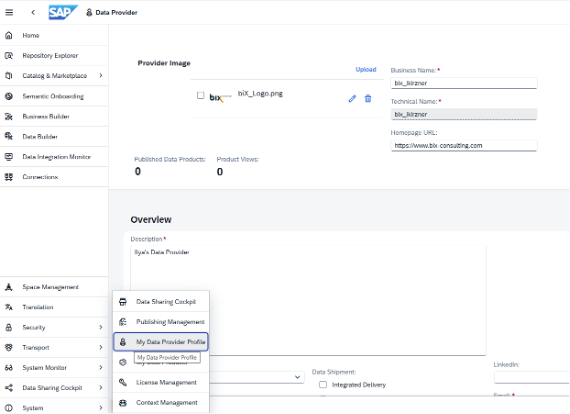

BPC-Modell nötig

Die normale Schnittstelle für eingabebereite Queries ist in den meisten Fällen Excel mit dem AfO-Plugin. Sie können aber Planungsqueries in SAC ohne Änderung und Verlust an Funktionalität ausführen (BW-Berechtigungen werden geprüft). Sie müssen „nur“ ein BPC-Modell erstellen, das in Ihrer Planungsverbindung von SAC aus verwendet werden soll. Dies wird im zweiten Blog der oben erwähnten Serie detailliert erklärt:

Wenn Sie keine berechtigungsrelevanten Attribute in Ihrem Modell haben, sind Sie fertig.

Wenn Sie jedoch berechtigungsrelevante Attribute in Ihrem Modell verwenden, müssen Sie ein Datenzugriffsprofil erstellen, das die Berechtigungen gewährt und die Profile zu den Benutzern hinzufügen. Falls Sie Probleme mit der Berechtigung haben, finden Sie in den folgenden Hinweisen eine Menge Informationen:

1994720 – Checkpoints: Authorization Issue for BPC User, Role, Task, Team and CUA configuration

2646117 – Checkpoints: BPC Embedded Model access via Analysis Office

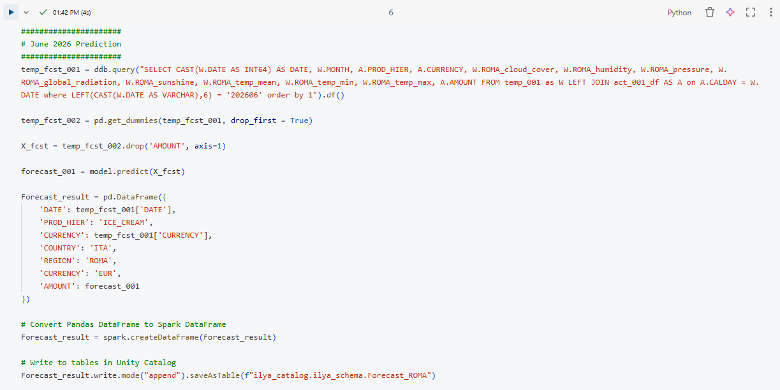

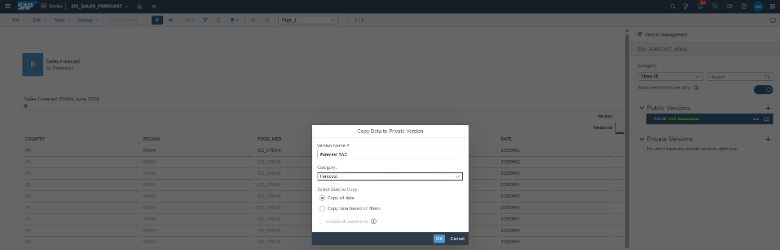

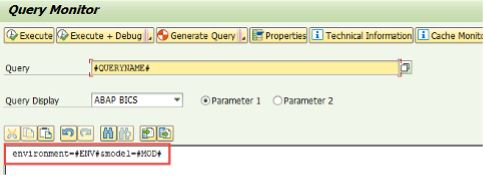

Häufig möchte man nur prüfen, ob eine Abfrage mit einem bestimmten Modell läuft oder ob man ein anderes Modell verwenden muss. Dies kann bereits innerhalb des SAP – GUIs in der Transaktion RSRT überprüft werden, wie im folgenden Hinweis beschrieben:

2824129 – Execute BW Query with BPC Environment and Model setting

Modelle für über SAC gestartete Planungssequenzen

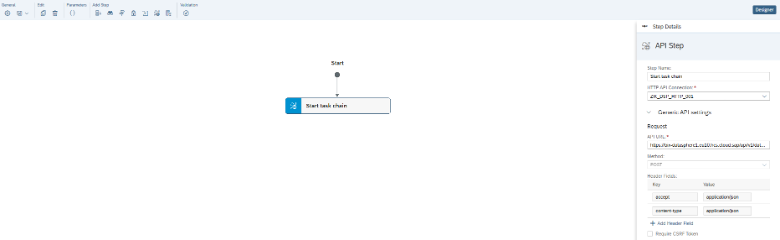

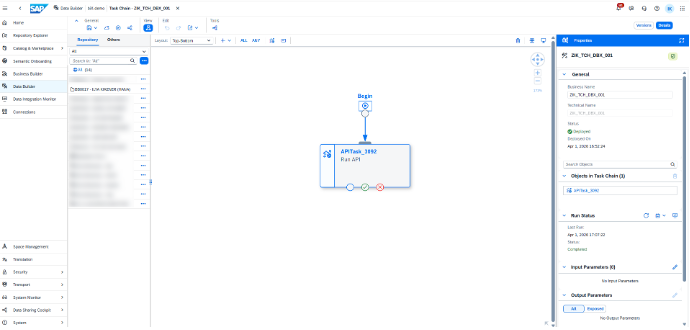

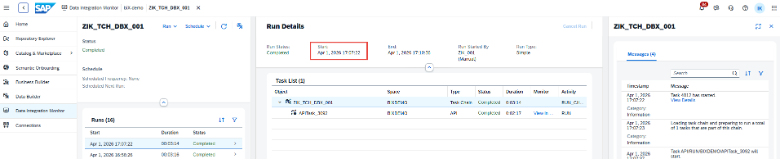

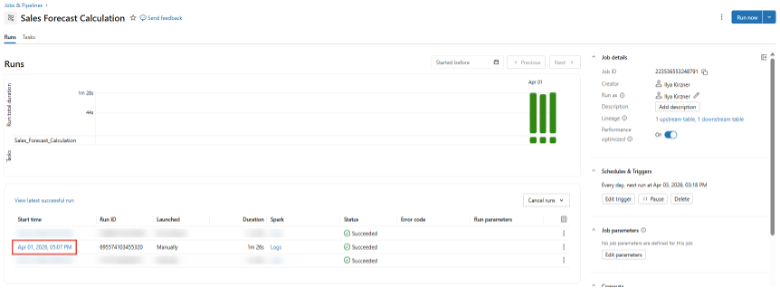

Sie können Planungssequenzen über SAC starten, wie in diesem Blog beschrieben:

Sie können eine Prozesskette auch über eine Funktion in einer Planungssequenz starten, wie hier beschrieben:

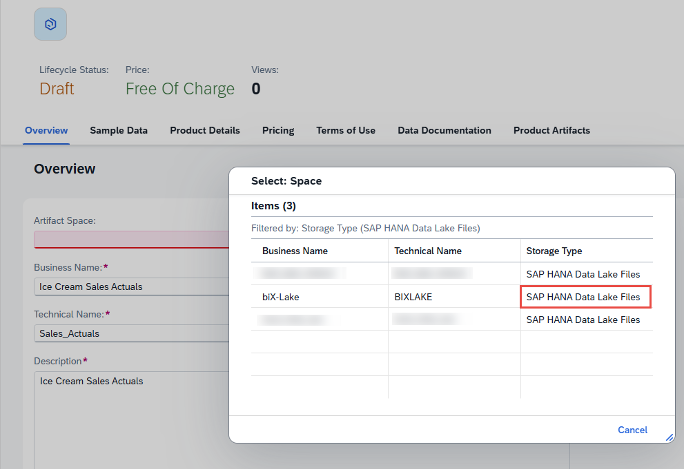

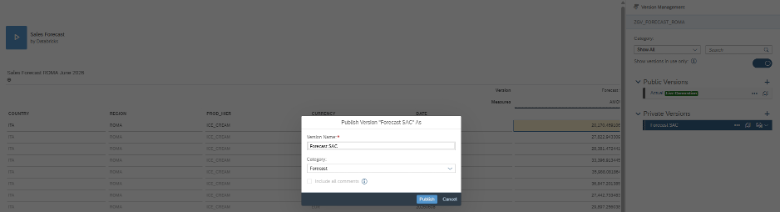

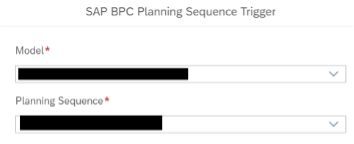

Für die Definition des „BPC-Planungssequenz-Triggers“ müssen Sie ein SAC-Modell und die Planungssequenz angeben:

Wenn Sie keine Berechtigungseinschränkungen haben, können Sie jedes beliebige SAC-Modell verwenden. Sobald Sie jedoch Berechtigungen haben, prüft SAP die Berechtigung auf der Grundlage des BPC-Modells, das dem SAC-Modell zugeordnet ist!

Das hat gut funktioniert, aber die folgenden zwei Themen haben uns einige Stunden Zeit gekostet, sie zu lösen.

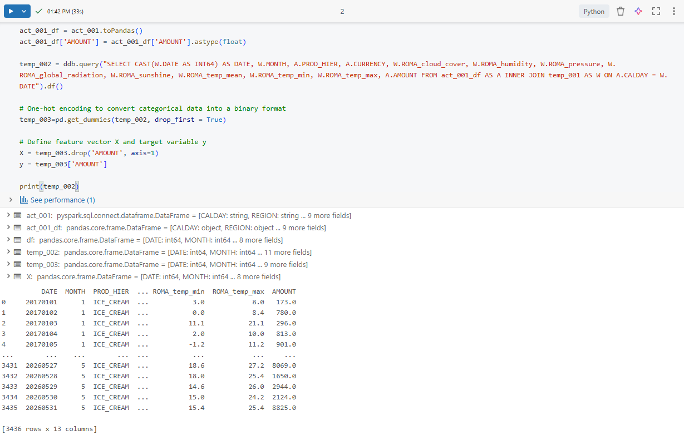

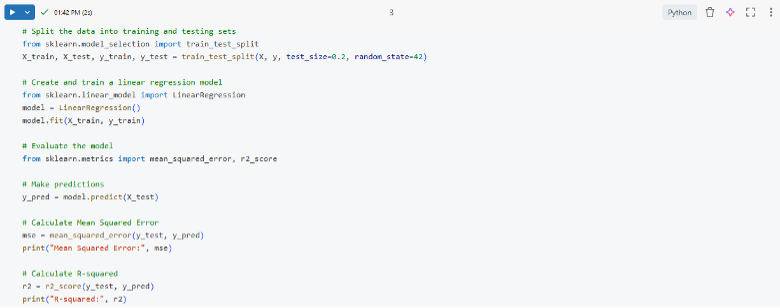

- Unsere Planungssequenz lief in RSPLAN ohne Fehler, schlug aber mit einem Berechtigungsproblem fehl, wenn sie über SAC ausgelöst wurde. Das Problem bestand darin, dass die Planungssequenz mehrere Schritte mit Aggregationsstufen auf verschiedenen Composite Provider enthielt! Da Sie der Planungssequenz nur ein SAC-Modell mit einem zugehörigen BPC-Modell hinzufügen können, muss dieses BPC-Modell ALLE in der Planungssequenz verwendeten Composite Provider enthalten, auch wenn sie nicht zur Ausführung der im SAC-Modell definierten ursprünglichen Query erforderlich sind. Leider können Sie dies nur über die SAC-Schnittstelle testen und nicht bereits im SAP-GUI (was in unserem Fall einen Transport bedeutet …)

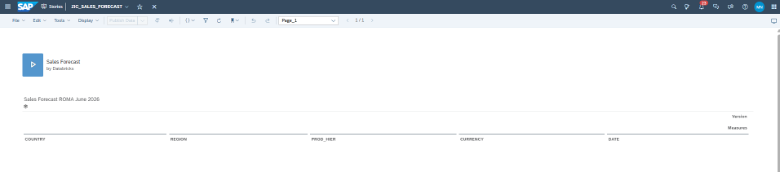

- Wenn Sie die SAC-Button bearbeiten, können Sie das Modell und die Planungsreihenfolge ändern und der Button wird die neuen Einstellungen verwenden. Aber wenn Sie das alte SAC-Modell aus der SAC-Story entfernen wollen, ist das nicht möglich. SAC teilt Ihnen mit, dass das Modell noch in einem Button verwendet wird…. Die einzige Möglichkeit, das Modell aus der SAC-Story zu entfernen, besteht darin, die Schaltfläche zu löschen und eine neue Schaltfläche zu erstellen.

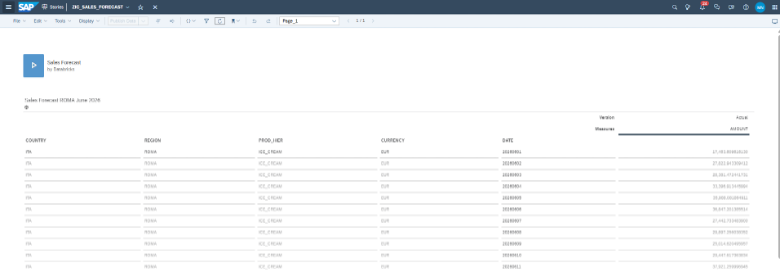

Stammdatenplanung in SAC und Berechtigungen in Modellen

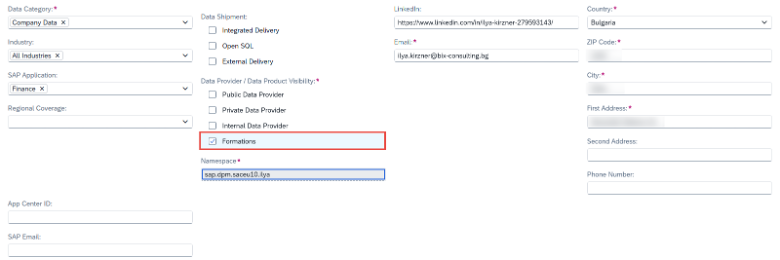

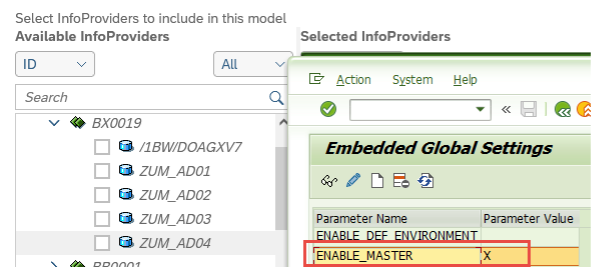

Schließlich ist es nun möglich, Stammdatenattribute über eine Planungs – Query zu pflegen (sog. Stammdatenplanung). Falls Sie die Stammdatenplanung auch in BPC nutzen wollen, müssen Sie dies im Customizing aktivieren:

Transaktion SRPO -> BPC -> Nur eingebettet -> Globale Einstellung -> Stammdaten aktivieren

Jetzt können Sie die Stammdatenplanung sogar über SAC durchführen. (Beachten Sie jedoch, dass Sie, wie oben bereits erwähnt, keine neuen Stammdaten über das SAC-Frontend anlegen können).

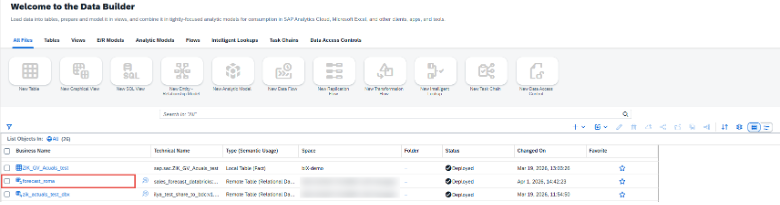

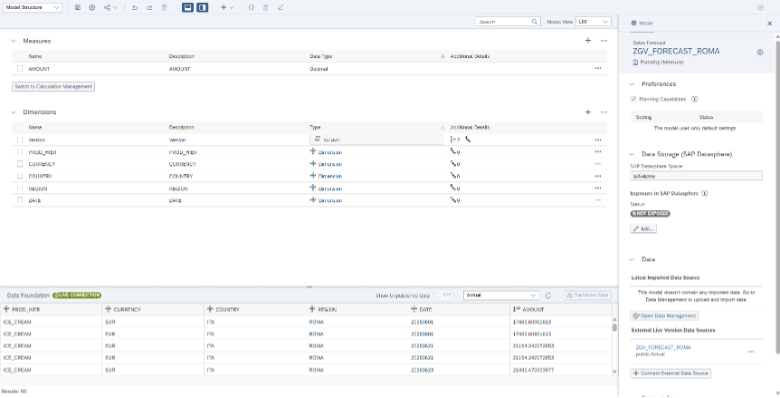

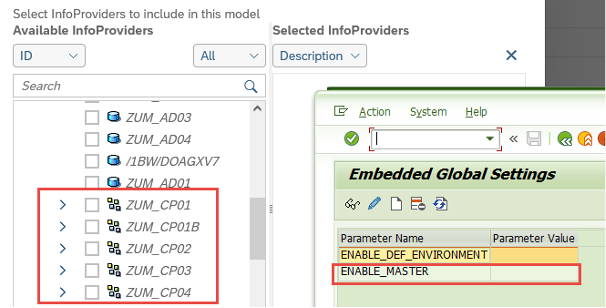

Wenn Sie Infoprovider zu einem BPC-Modell hinzufügen möchten, finden Sie nun keine Composite Provider mehr:

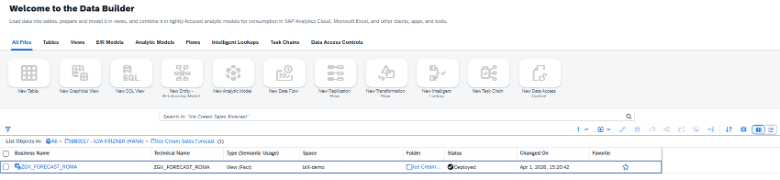

Es ist jedoch kein Problem, einem Modell Composit Provider hinzuzufügen oder zu ändern. Entfernen Sie einfach vorübergehend das Kennzeichen, ändern Sie die erforderlichen Einstellungen im Modell und setzen Sie das Kennzeichen erneut:

Sie müssen das Kennzeichen nur für den Wechsel des Modells entfernen. Für den Transport und im Zielsystem brauchen Sie das Kennzeichen nicht zu entfernen.

Achtung, denken Sie daran, das Flag zum Aktivieren von Stammdaten zu setzen, bevor Sie ein Datenzugriffsprofil ändern!!

Wenn Sie das Datenzugriffsprofil mit entferntem „enable_master“ eingeben, werden alle Modelle mit Stammdaten aus dem Profil gelöscht!

Fazit

BPC über SAC funktioniert hervorragend. Lediglich ein paar kleine Probleme können etwas Aufwand verursachen, sind aber lösbar.

Erstellt im Juni 2024