März 2026

Vom manuellen Erstellen zur intelligenten Validierung

Voraussetzungen für die Nutzung des Tableau Agents

Bevor wir in Tableau Desktop starten, ist ein kurzer Blick auf die technischen Voraussetzungen für die Nutzung des Tableau Agents notwendig. Die Integration von generativer KI in Tableau ist kein rein lokales Feature (in Tableau Desktop), sondern ein Cloud-/Server-Feature, das spezifische Anforderungen an die Architektur stellt.

Damit der Tableau Agent effizient arbeiten kann, müssen folgende Voraussetzungen erfüllt sein:

- Infrastruktur: Der Tableau Agent ist ein Cloud-Service. Die Nutzung erfordert Tableau Desktop (ab 2025.1) zwingend in Verbindung mit Tableau Cloud (Edition Tableau+) oder Tableau Server (ab 2025.3).

- Datenanbindung: Damit die KI die Semantik versteht, müssen die Daten (z. B. Superstore) als publizierte Datenquelle oder Extrakt in Ihrer Cloud- bzw. Server-Umgebung vorliegen.

- Datenschutz: In der Cloud garantiert der Einstein Trust Layer, dass Ihre Daten nicht zum Training öffentlicher KI-Modelle genutzt werden. Bei der Server-Nutzung (On-Premise) greifen Ihre individuellen Sicherheitsrichtlinien für die LLM-Anbindung.

Für unser Szenario nutzen wir den „Sample – Superstore“, da er eine Mischung aus Transaktionsdaten (Bestellungen), geografischen Informationen und Produkthierarchien bietet – ideal, um die Fähigkeiten des Agenten zu testen.

Der Einstieg – Schnelle Orientierung statt leerer Arbeitsfläche

Es ist eine bekannte Situation: Man verbindet sich mit einer neuen Datenquelle und sieht zunächst nur eine lange Liste von Tabellen und Feldern. Sofern nicht bereits konkrete Anforderungen für das Dashboard bestehen, steht man vor der ersten Hürde: Man muss sich einen ersten Überblick verschaffen und sinnvolle Zusammenhänge erkennen. Oft wird hier viel Zeit investiert, nur um die Datenstruktur zu verstehen.

Der Tableau Agent bietet hier eine effiziente Unterstützung durch “Vorschläge” bzw. „Recommended Questions“. Sobald die Verbindung zur Datenquelle steht, analysiert der Agent im Hintergrund die Metadaten. Er erkennt Zeitreihen, kategorische Felder und Kennzahlen. Dies ermöglicht die Erstellung erster Visualisierungen und die Hervorhebung von Datenzusammenhängen, um die Daten initial besser verstehen zu können.

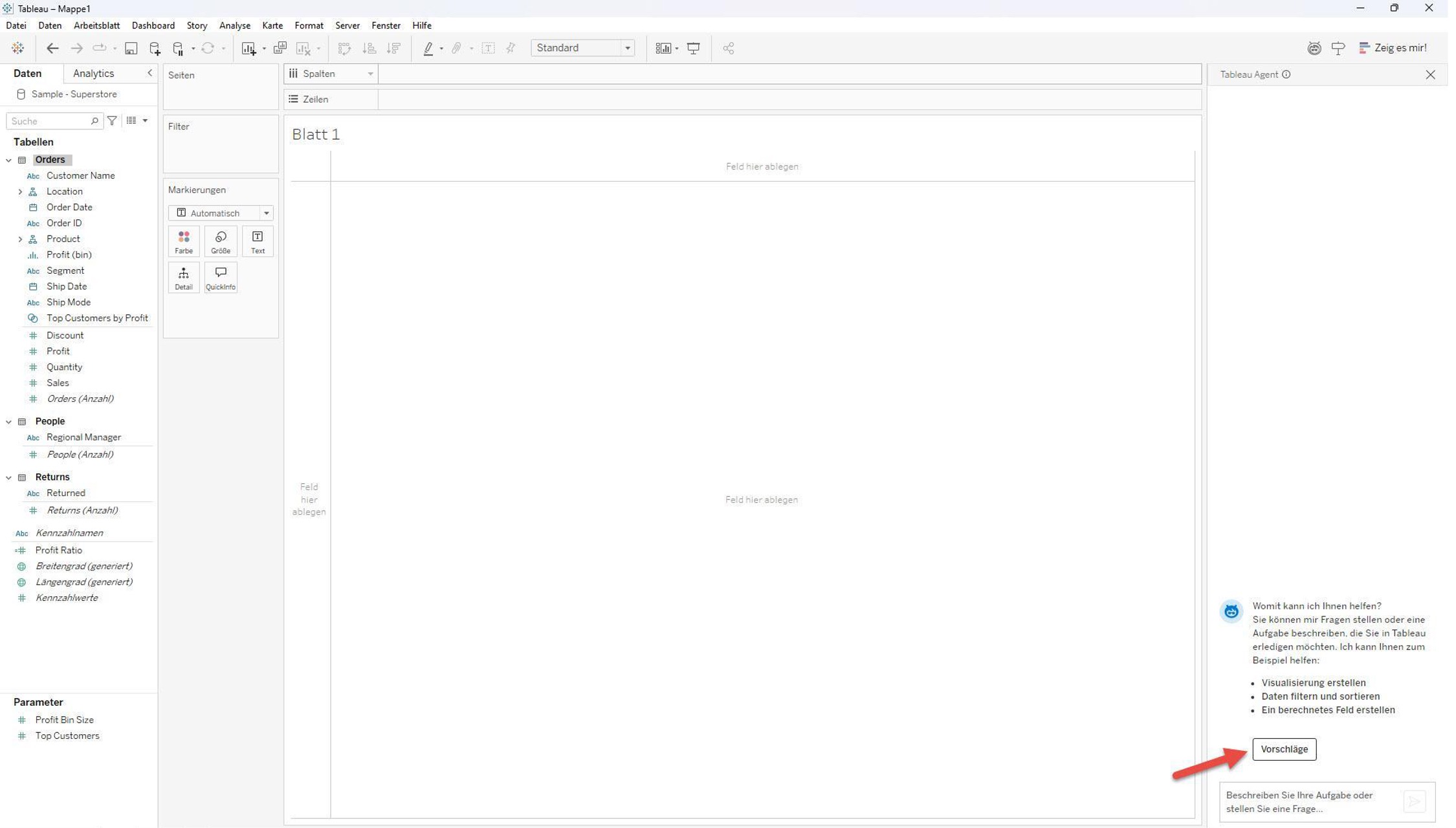

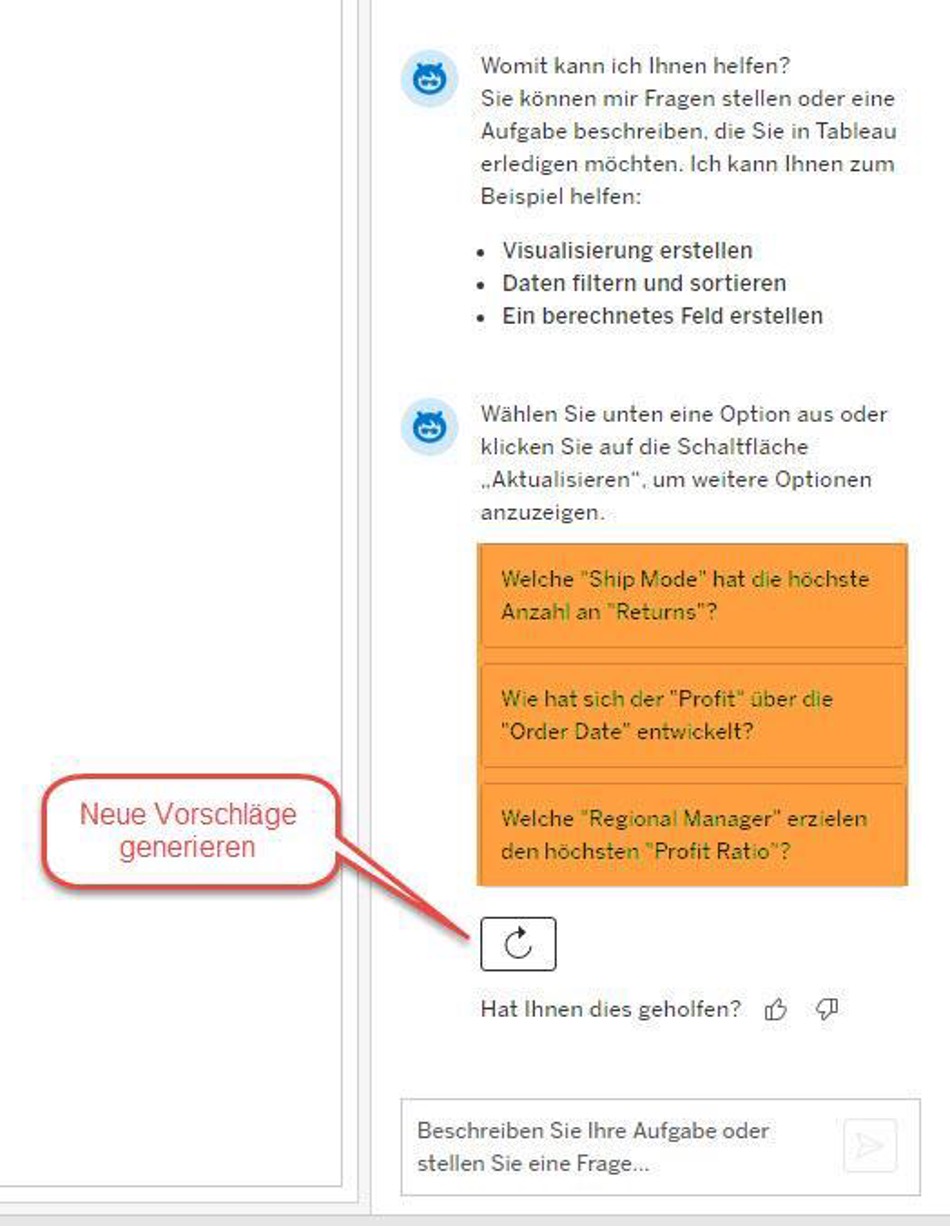

Als praktisches Einstiegsbeispiel stellen wir zunächst in Tableau eine Verbindung mit dem Superstore-Datensatz her und rufen dann das Agent-Panel auf. Anstatt manuell Felder in den Arbeitsbereich zu ziehen, schlägt der Agent kontextbezogene Fragen vor:

Ein Klick auf einen dieser Vorschläge generiert sofort eine erste Ansicht.

Diese Funktion dient als Beschleuniger. Sie ermöglicht es dem Analysten, sofort in die Validierung von Hypothesen einzusteigen, anstatt Zeit mit dem mechanischen Aufbau von “Basis”-Charts zu verbringen. Es geht hier nicht darum ein fertiges Endergebnis zu generieren, sondern um den schnellstmöglichen Einstieg in den Analysefluss.

Visualisierung durch natürliche Sprache (Text-to-Viz)

Nachdem wir einen ersten Überblick gewonnen haben, wollen wir spezifische Fragestellungen untersuchen. Nehmen wir an, wir möchten das Verhältnis von Umsatz und Gewinn analysieren, und zwar detailliert auf Ebene der Produkt-Unterkategorien.

Traditionell erfordert dies mehrere Schritte: Die Auswahl des richtigen Diagrammtyps, das Platzieren der Kennzahlen auf die korrekten Achsen und das Hinzufügen von Dimensionen für Detailgrad und Farbe. Mit dem Tableau Agent können wir diesen Wunsch in natürlicher Sprache formulieren.

Der Prompt: „Erstelle ein Streudiagramm für Umsatz und Gewinn pro Unterkategorie. Färbe die Punkte nach Kategorie.“

Die Umsetzung durch die KI: Der Agent übersetzt diese textliche Absicht in VizQL (Visual Query Language). Er führt dabei folgende Schritte autonom aus:

- Auswahl von SUM(Sales) und SUM(Profit) für die Achsen.

- Nutzung von Sub-Category im Detail-Container, um die Granularität festzulegen.

- Nutzung von Category in der Farbe, um den visuellen Kontext zu liefern.

- Wahl des Markierungstyps „Form“.

Das Ergebnis ist eine fertige Visualisierung. Der Analyst muss hier nicht mehr über die technische Umsetzung nachdenken, sondern kann sich sofort auf das Muster in den Daten konzentrieren: Gibt es Cluster? Gibt es Ausreißer?

Berechnung und Logik – Semantik vor Syntax

Eine häufige Herausforderung in der Datenanalyse ist die Erstellung komplexer berechneter Felder. Während die Geschäftslogik oft klar ist („Ich brauche die Dauer zwischen Bestellung und Versand“), scheitert die Umsetzung häufig an der exakten Syntax der Formelsprache im BI-Tool.

Der Tableau Agent fungiert hier als “Übersetzer“. Der Analyst liefert die fachliche Anforderung, die KI liefert den korrekten Code.

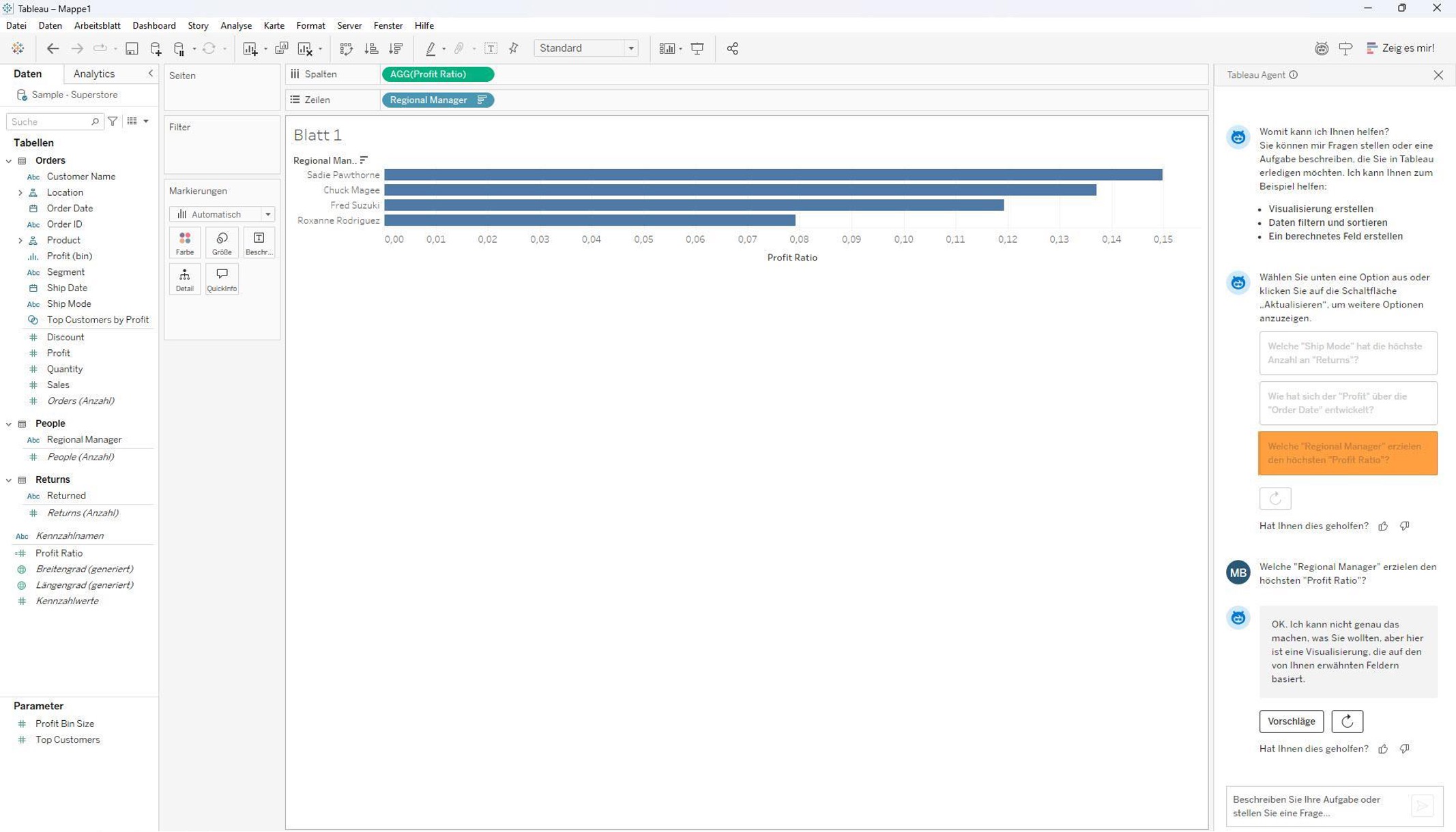

Beispiel A: Logistik-Analyse (Zeitberechnungen) Wir wollen die Effizienz unserer Lieferkette prüfen:

Ergebnis: Der Agent generiert den Code DATEDIFF(‚day‘, [Order Date], [Ship Date]). Er erkennt automatisch die relevanten Datumsfelder im Superstore-Datensatz und wählt die passende Funktion.

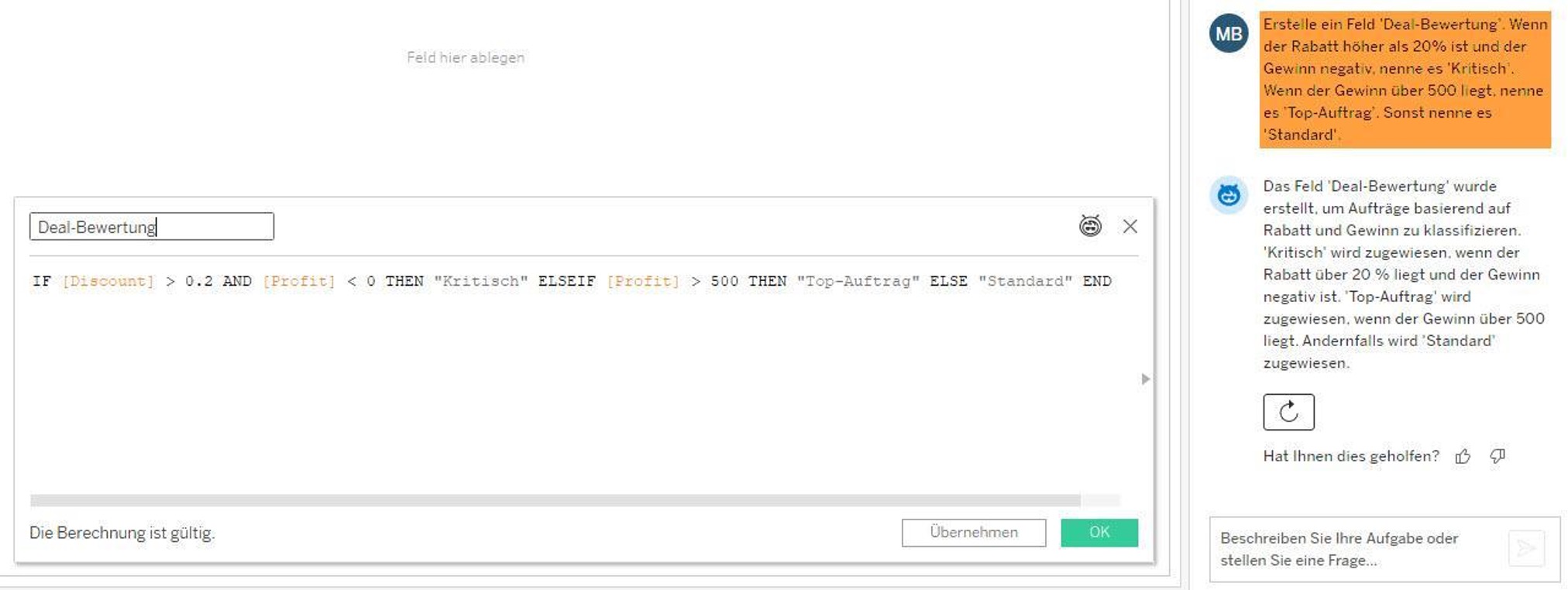

Beispiel B: Geschäftslogik (Segmentierung von Transaktionen)

Oft müssen Daten nicht nur berechnet, sondern nach geschäftlichen Regeln kategorisiert werden. Wir wollen Aufträge identifizieren, die zwar Umsatz bringen, aber durch hohe Rabatte unrentabel sind.

Ergebnis: Der Agent übersetzt diese gesprochene Logik in eine passende Syntax. Er erkennt dabei automatisch, dass „20%“ im Code als 0.2 geschrieben werden muss:

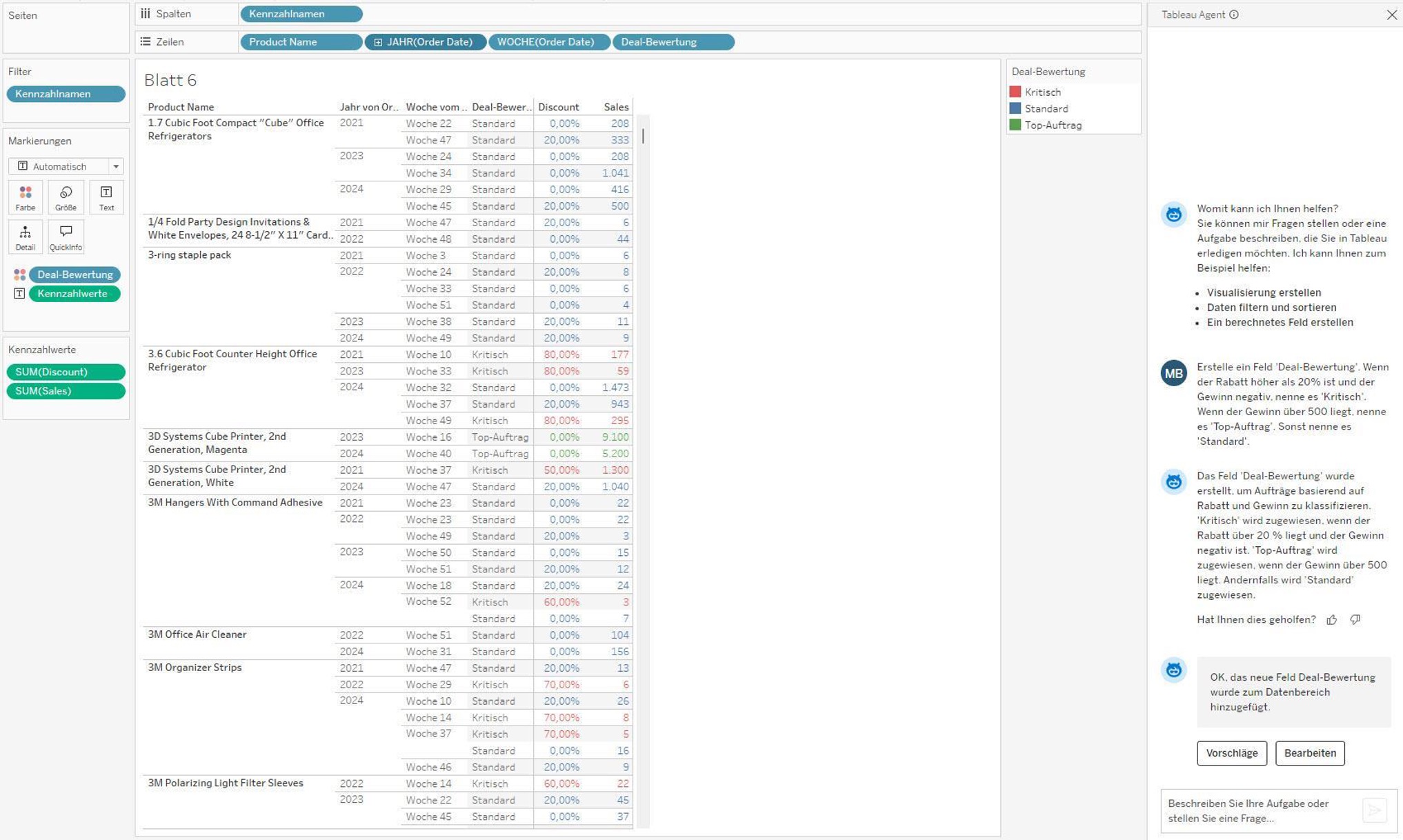

Die neu-erstellte Berechnung kann dann in beliebigen Visualisierungen eingesetzt werden.

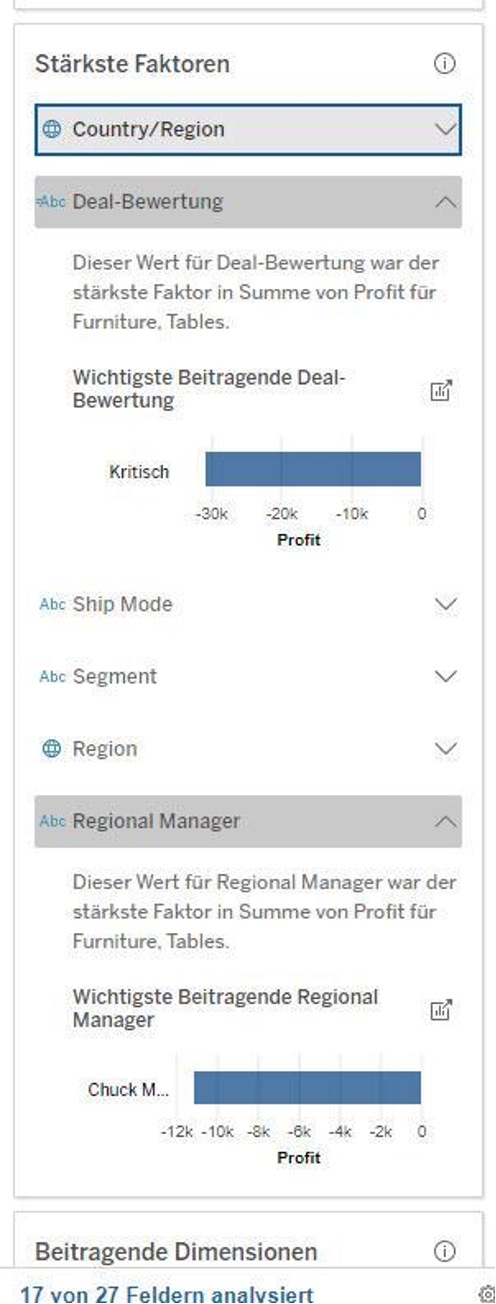

Explain Data – Statistische Ursachenforschung

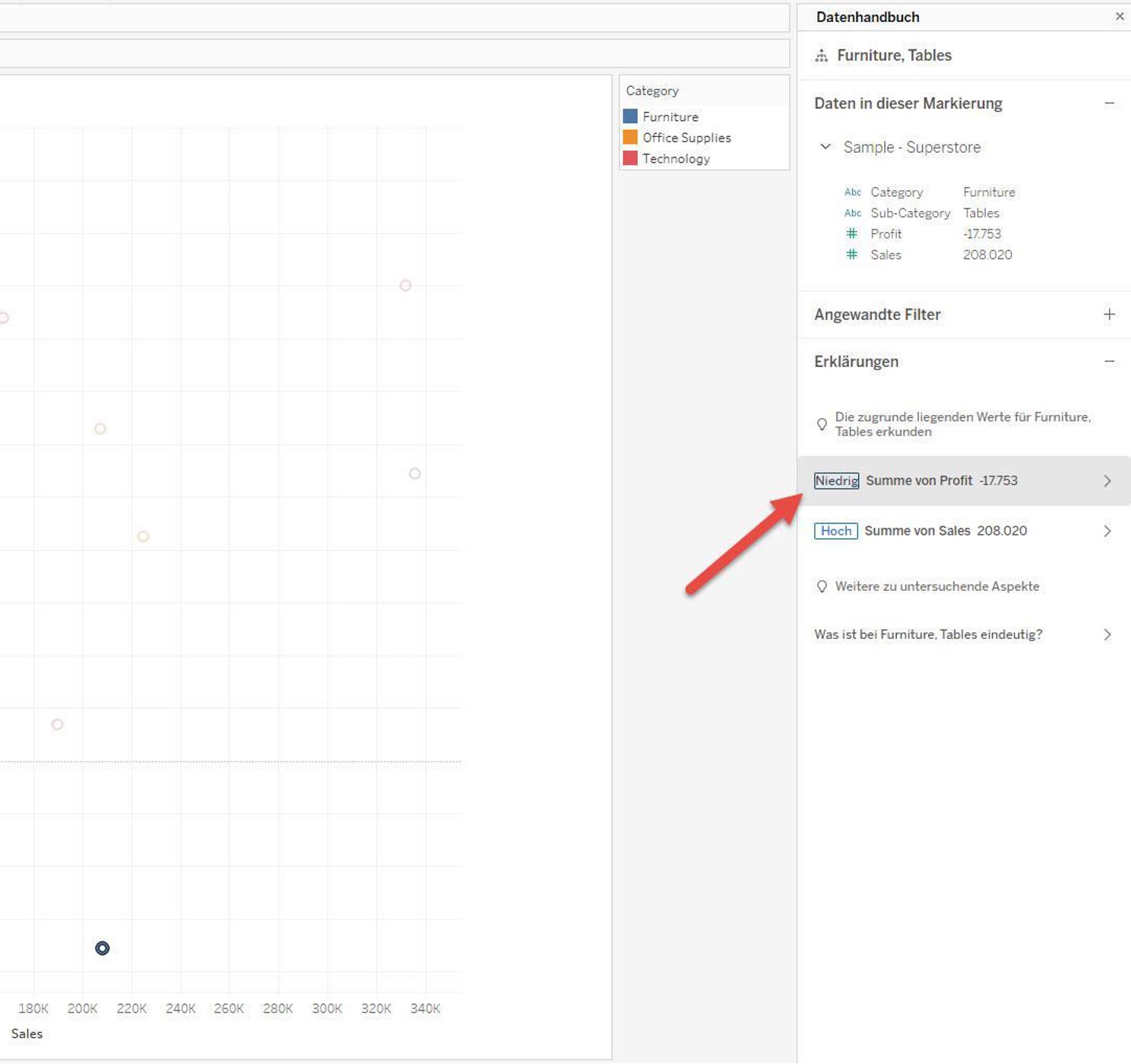

Zurück zu unserer KI-generierten Visualisierung. Wir sehen nun die Datenpunkte, und vielleicht fällt auf, dass die Kategorie „Tables“ (Tische) ungewöhnlich schlecht abschneidet. Ein klassisches Dashboard zeigt uns das „Was“. Das „Warum“ musste der Analyst bisher mühsam durch manuelles Filtern und Suchen („Drill-Down“) ermitteln.

Hier greift die KI-Komponente „Datenhandbuch“, die nahtlos in den Workflow integriert ist.

- Wir klicken in der Visualisierung auf den auffälligen Datenpunkt (z. B. den Punkt für „Tables“).

- Wir klicken auf das Symbol des Datenhandbuchs.

Tableau prüft im Hintergrund mögliche Erklärungsmodelle. Es testet Korrelationen, die wir vielleicht nicht in Betracht gezogen hatten.

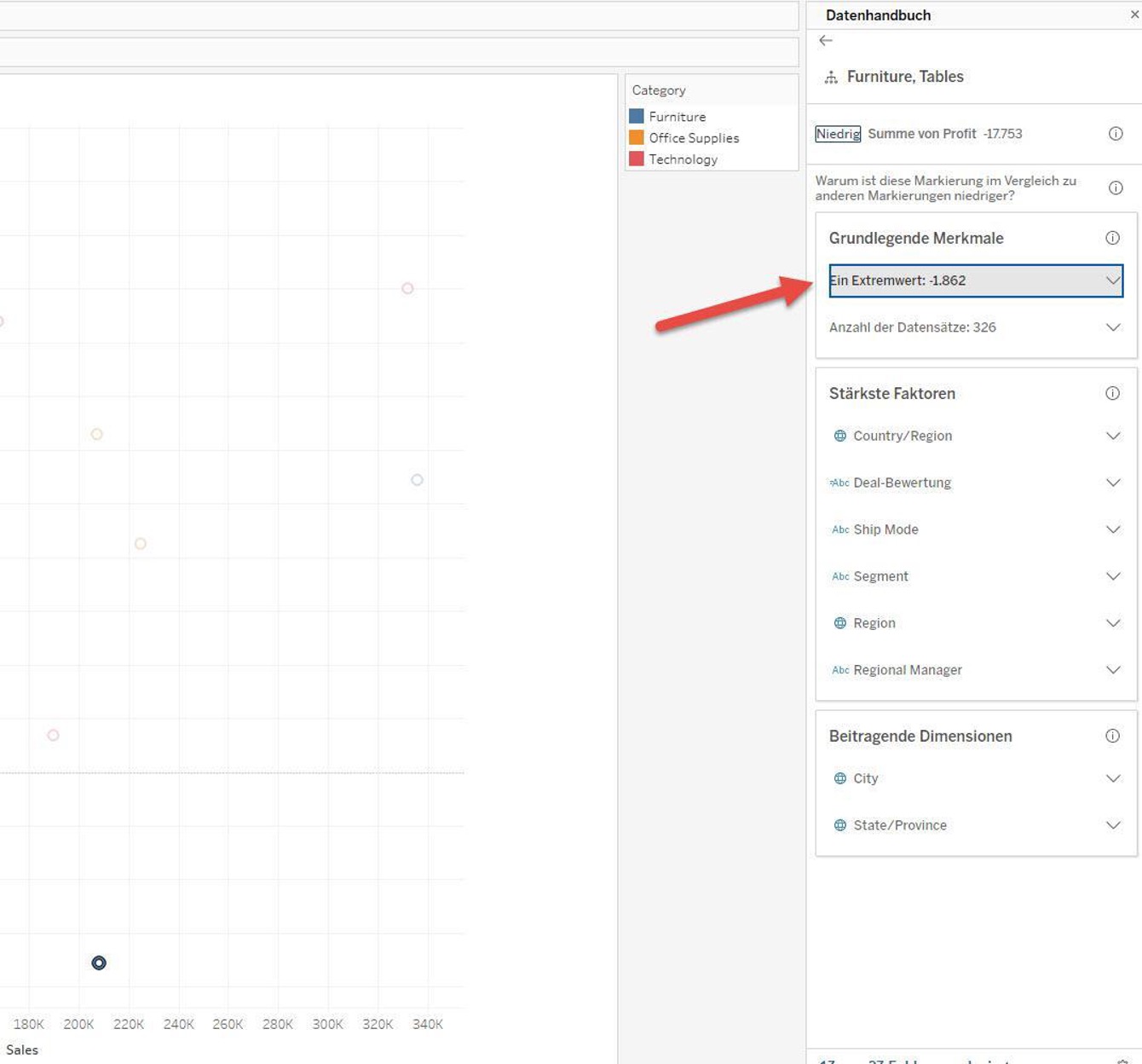

Das Ergebnis: Das Datenhandbuch mit den Hauptmerkmalen des gewählten Datenpunkts wird im rechten Seitenfenster angezeigt. Dort kann man bestimmen, welche Werte im Detail untersucht werden sollen. Unser Interesse gilt in diesem Fall dem bereits als „niedrig“ klassifizierten „Profit“.

Das nachfolgende Fenster präsentiert die grundlegenden Merkmale und Einflussfaktoren, die den negativen Ausreißer in diesem Fall bedingen könnten. So können wir herausfinden, wodurch diese negativen Ausreißer entstanden sind, und können dementsprechend aktiv werden.

Weitere Details können bei Bedarf aufgeklappt werden. Im vorliegenden Beispiel liegt die Vermutung nahe, dass ein oder mehrere „kritische“ Deals abgewickelt wurden. Diese lassen sich auch mit Hilfe der Formel identifizieren, die wir in einem der vorherigen Schritte zur Berechnung generiert haben und welche nun auch im Datenhandbuch berücksichtigt wird.

Dieser Schritt markiert den Übergang von deskriptiver Analytik (Was ist passiert?) zu diagnostischer Analytik (Warum ist es passiert?). Die KI übernimmt die Rolle eines unvoreingenommenen Statistikers, der auch Zusammenhänge prüft, nach denen der Mensch aufgrund von „Confirmation Bias“ vielleicht gar nicht gesucht hätte. Dennoch bleibt der menschliche Analyst weiterhin ein unverzichtbarer Teil des Prozesses und muss die präsentierten Ergebnisse stets kritisch hinterfragen. So könnte im obigen Beispiel näher betrachtet werden, warum unprofitable Deals abgeschlossen wurden. Auf dieser Basis können Prozesse oder Bewertungskriterien in Zukunft angepasst werden.

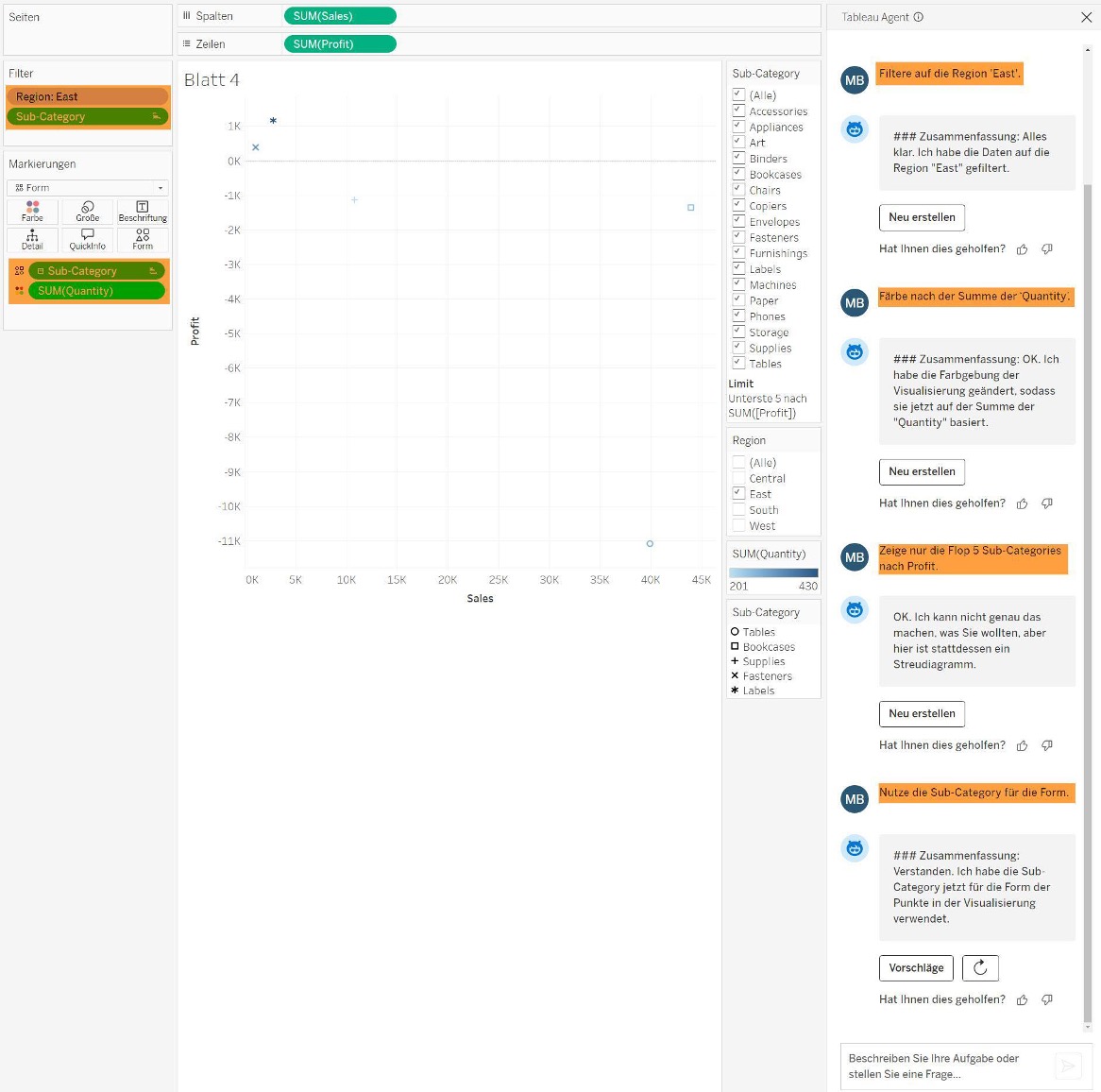

Interaktive Verfeinerung der Ansicht

Oft ist der erste Entwurf noch nicht perfekt. Anstatt sich nun durch Menüs zu klicken, nutzen wir den Agenten, um die Ansicht iterativ zu verbessern. Wir wollen den Fokus auf die aktuellen Zahlen legen und die Analyse optimieren. Gleichzeitig wollen wir die hierfür notwendigen Entwicklungsschritte beschleunigen und vereinfachen.

Die Stärke der KI liegt hier in der schnellen Manipulation der Ansicht (View Modifications).

Funktionierende Prompts für den Feinschliff:

1. Geografischer Filter:

- „Filtere auf die Region ‚East‘.“

- (Eine sichere Methode, um den Datenumfang gezielt einzugrenzen.)

2. Kontext durch Farbe:

- „Färbe nach der Summe der ‘Quantity’.“

- (Der Agent nutzt automatisch eine divergierende Palette.)

3. Fokus setzen:

- „Zeige nur die Flop 5 Sub-Categories nach Profit.“

- (Der Agent erstellt automatisch einen Filter)

4. Unterscheidbarkeit sicherstellen:

- “Nutze die Sub-Category für die Form.”

- (Der Agent legt die Sub-Category als Mermal für die angezeigten Formen fest).

Fazit: Der Analyst als Qualitätsmanager

Die Anwendung der KI-Funktionen im Superstore-Szenario zeigt, dass der Tableau Agent weit mehr ist als eine technische Spielerei. Diese Funktionen erleichtern und beschleunigen Analysten den Einstieg in das Tool und ermöglichen ein effizienteres Arbeiten.

Die wesentlichen Vorteile lassen sich wie folgt zusammenfassen:

- Geschwindigkeit (Time-to-Insight): Die Zeit zwischen der analytischen Frage und der visuellen Antwort wird drastisch reduziert.

- Qualitätssicherung: Da der Agent Syntax für Berechnungen generiert, werden Syntaxfehler eliminiert. Der Analyst konzentriert sich auf die logische Validierung.

- Barrierefreiheit: Komplexe Methoden wie RegEx oder statistische Erklärungsmodelle werden auch für Anwender zugänglich, die keine tiefen Programmierkenntnisse besitzen.

Die Einführung dieser Technologie erfordert ein Umdenken in den BI-Teams. Wir bewegen uns weg von der reinen Erstellung („Wie bediene ich das Tool?“) hin zur Validierung und Interpretation („Stimmt das Ergebnis und was bedeutet es für das Business?“). Der Analyst der Zukunft verbringt weniger Zeit mit dem „Wie“ und mehr Zeit mit dem „Warum“.